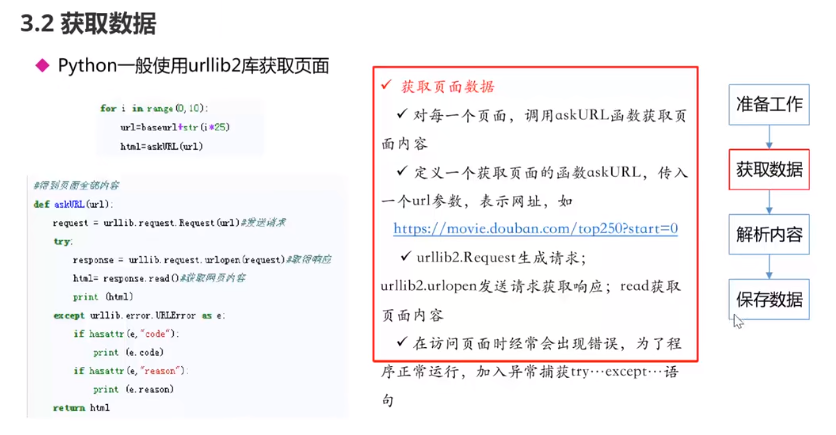

1.上一篇讲了爬虫概述和urllib库,这篇讲解如何获取数据

打开上次写好的spider.py文件,继续写入以下代码:

# -*- coding=utf-8 -*- # @Time : 2020/12/16 0016 下午 7:09 # @Author :东南大学软件学院陈洋 # @File :spider.py # @Software :PyCharm from bs4 import BeautifulSoup #网页解析,获取数据 import re #正则表达式,进行文字匹配 import urllib.request,urllib.error #制定URL,获取网页数据 import xlwt #进行excel操作 import sqlite3 #进行sqlite数据库操作 def main(): baseurl="https://movie.douban.com/top250?start=" #1.爬取网页 datalist=getData(baseurl) savepath=".\豆瓣电影Top250.xls" #3.保存数据 # saveData(savepath) askURl("https://movie.douban.com/top250?start=0") #爬取网页 def getData(baseurl): datalist=[] for i in range(0,10): #调用获取信息的函数10次 url=baseurl+str(i*25) html=askURl(url) #保存获取到的网页源码 # 2.逐一解析数据 return datalist #得到指定URL网页内容 def askURl(url): head={ #模拟浏览器头部信息,向豆瓣服务器发送请求 "User-Agent": "Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/78.0.3904.108 Safari/537.36" } #用户代理,表示告诉豆瓣服务器,我们是什么类型的机器 request=urllib.request.Request(url,headers=head) html="" try: response=urllib.request.urlopen(request) html=response.read().decode("utf-8") print(html) except urllib.error.URLError as e: if hasattr(e,"code"): print(e.code) if hasattr(e,"reason"): print(e.reason) return html #3.保存数据 def saveData(savepath): print("save....") if __name__=="__main__": #当程序执行时 #调用函数 main()

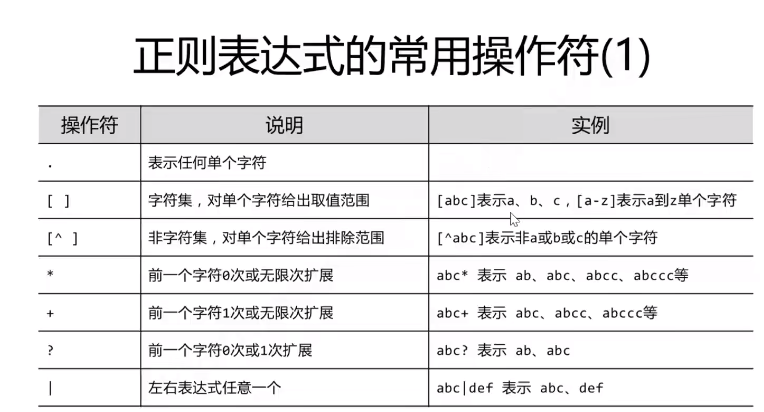

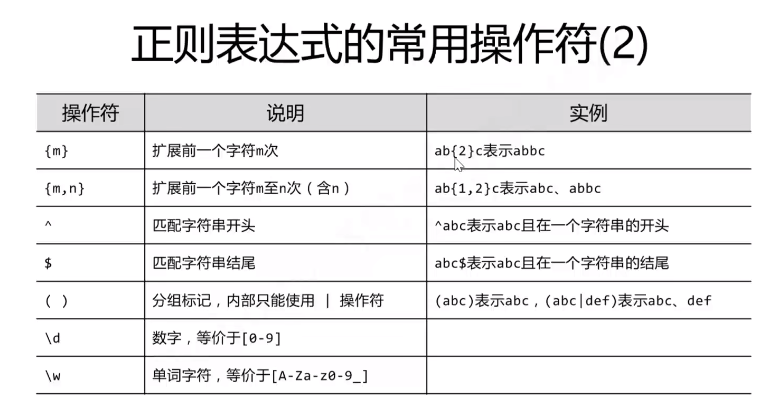

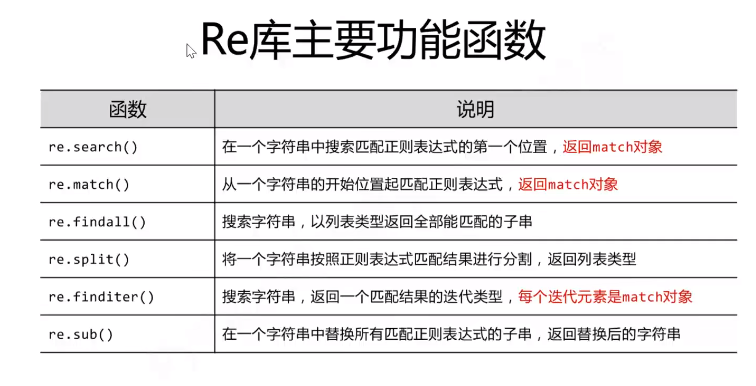

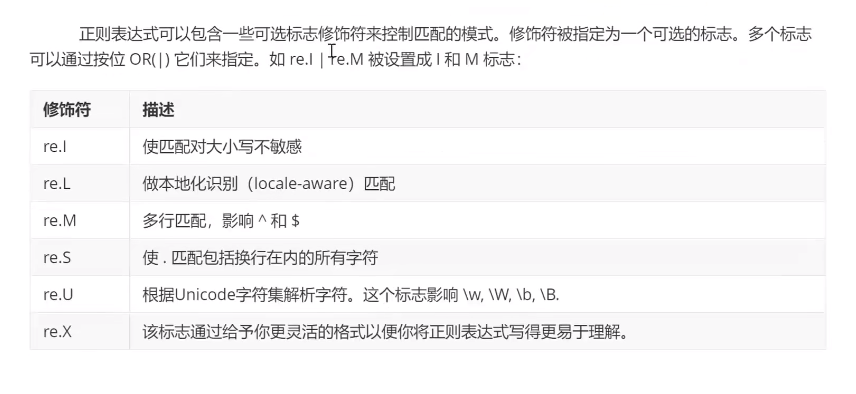

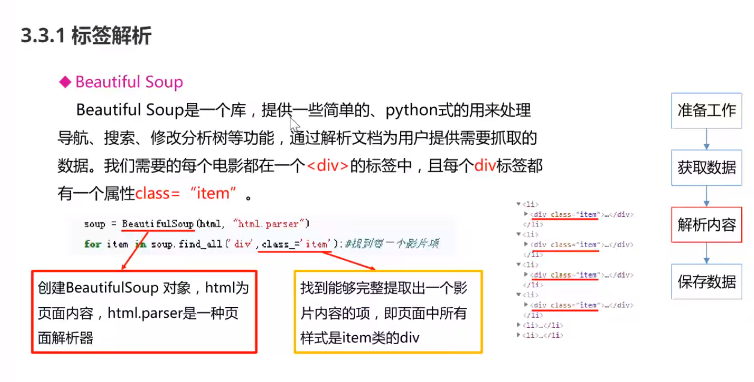

补充beautifulsoup知识(见视频,不多赘述)下面是正则表达式

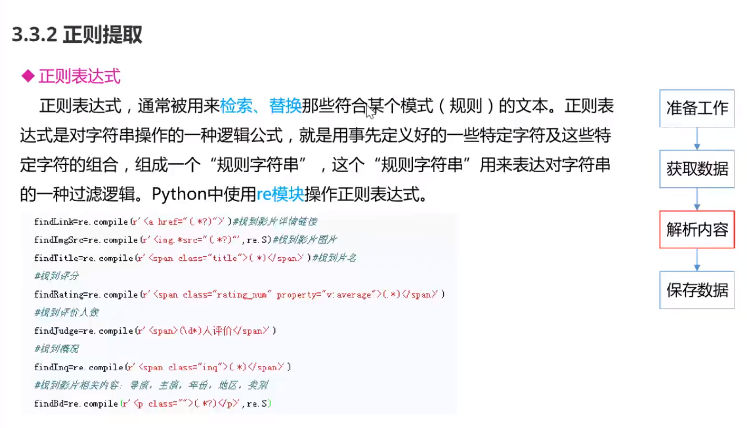

正则提取:

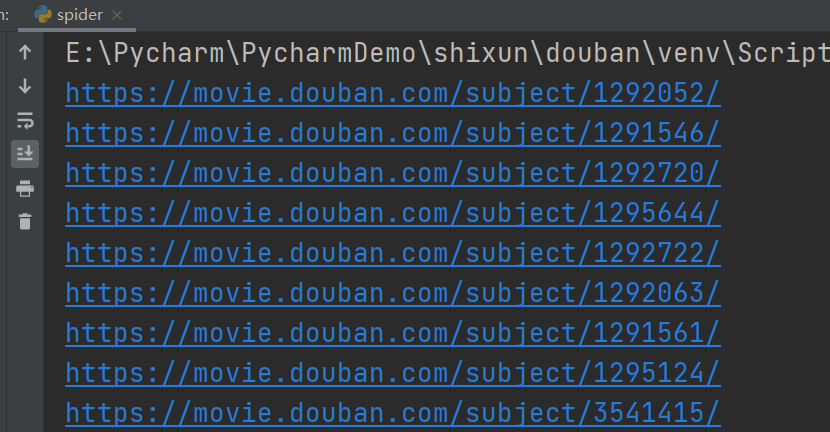

继续再spider.py写入以下代码:爬取豆瓣第一页所有的链接

# -*- coding=utf-8 -*- # @Time : 2020/12/16 0016 下午 7:09 # @Author :东南大学软件学院陈洋 # @File :spider.py # @Software :PyCharm from bs4 import BeautifulSoup #网页解析,获取数据 import re #正则表达式,进行文字匹配 import urllib.request,urllib.error #制定URL,获取网页数据 import xlwt #进行excel操作 import sqlite3 #进行sqlite数据库操作 def main(): baseurl="https://movie.douban.com/top250?start=" #1.爬取网页 datalist=getData(baseurl) savepath=".\豆瓣电影Top250.xls" #3.保存数据 # saveData(savepath) # askURl("https://movie.douban.com/top250?start=0") findLink=re.compile(r'<a href="(.*?">)') #创建正则表达式对象,表示规则(字符串的模式) #爬取网页 def getData(baseurl): datalist=[] for i in range(0,1): #调用获取信息的函数10次 url=baseurl+str(i*25) html=askURl(url) #保存获取到的网页源码 # 2.逐一解析数据 soup=BeautifulSoup(html,"html.parser") for item in soup.find_all('div',class_="item"): #查找符合要求的字符串,形成列表 # print(item) #查看电影item全部信息 dada=[] #保存一部电影的全部信息 item=str(item) link=re.findall(findLink,item)[0] #re库用来通过正则表达式查找指定的字符串 print(link) return datalist #得到指定URL网页内容 def askURl(url): head={ #模拟浏览器头部信息,向豆瓣服务器发送请求 "User-Agent": "Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/78.0.3904.108 Safari/537.36" } #用户代理,表示告诉豆瓣服务器,我们是什么类型的机器 request=urllib.request.Request(url,headers=head) html="" try: response=urllib.request.urlopen(request) html=response.read().decode("utf-8") # print(html) except urllib.error.URLError as e: if hasattr(e,"code"): print(e.code) if hasattr(e,"reason"): print(e.reason) return html #3.保存数据 def saveData(savepath): print("save....") if __name__=="__main__": #当程序执行时 #调用函数 main()

运行如下:

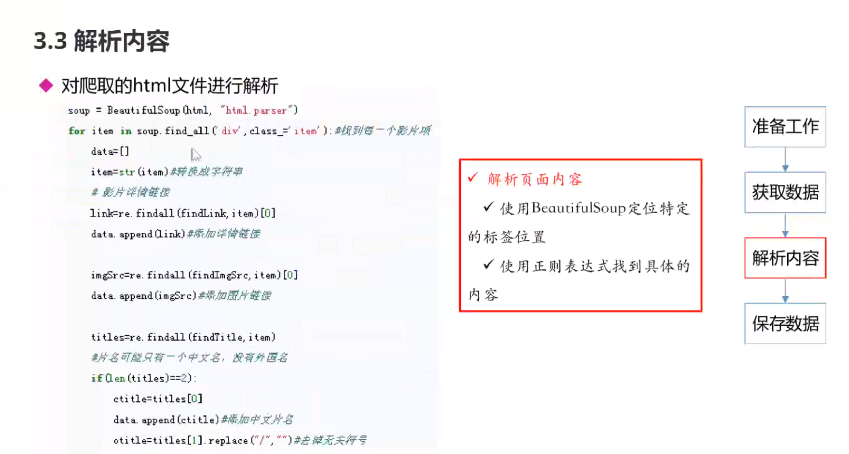

继续写入以下代码,可以打印一页所有信息(比如下面网址,图片地址,片名等信息)

# -*- coding=utf-8 -*- # @Time : 2020/12/16 0016 下午 7:09 # @Author :东南大学软件学院陈洋 # @File :spider.py # @Software :PyCharm from bs4 import BeautifulSoup #网页解析,获取数据 import re #正则表达式,进行文字匹配 import urllib.request,urllib.error #制定URL,获取网页数据 import xlwt #进行excel操作 import sqlite3 #进行sqlite数据库操作 def main(): baseurl="https://movie.douban.com/top250?start=" #1.爬取网页 datalist=getData(baseurl) savepath=".\豆瓣电影Top250.xls" #3.保存数据 # saveData(savepath) # askURl("https://movie.douban.com/top250?start=0") #影片详情链接的规则 findLink=re.compile(r'<a href="(.*?)">') #创建正则表达式对象,表示规则(字符串的模式) #影片图片 findImgSrc=re.compile(r'<img.*src="(.*?)"',re.S)#re.S让换行符包含在字符中 #影片片名 findTitle=re.compile(r'<span class="title">(.*)</span>') #影片评分 findRating=re.compile(r'<span class="rating_num" property="v:average">(.*)</span>') #找到评价人数 findJudge=re.compile(r'<span>(d*)人评价</span>') #找到概况 findInq=re.compile(r'<span class="inq">(.*)</span>') #找到影片的相关内容 findBd=re.compile(r'<p class="">(.*?)</p>',re.S) #爬取网页 def getData(baseurl): datalist=[] for i in range(0,1): #调用获取信息的函数10次 url=baseurl+str(i*25) html=askURl(url) #保存获取到的网页源码 # 2.逐一解析数据 soup=BeautifulSoup(html,"html.parser") for item in soup.find_all('div',class_="item"): #查找符合要求的字符串,形成列表 # print(item) #查看电影item全部信息 data =[] #保存一部电影的全部信息 item =str(item) #影片详情的超链接 link=re.findall(findLink,item)[0] #re库用来通过正则表达式查找指定的字符串 data.append(link) #添加链接 imgSrc=re.findall(findImgSrc,item)[0] data.append(imgSrc) #添加图片 titles=re.findall(findTitle,item) #片名可能只有一个中文名,没有外国名 if(len(titles)==2): ctitle=titles[0] data.append(ctitle) #添加中文名 otitle=titles[1].replace("/","") #去掉无关的符号 data.append(otitle) #添加外国名 else: data.append(titles[0]) data.append(' ') #外国名留空 rating=re.findall(findRating,item)[0] data.append(rating) #添加评分 judgeNum=re.findall(findJudge,item)[0] data.append(judgeNum) #添加评价人数 inq=re.findall(findInq,item) if len(inq)!=0: inq=inq[0].replace(" 。","") #去掉句号 data.append(inq) #添加概述 else: data.append(" ") #留空 bd=re.findall(findBd,item)[0] bd=re.sub('<br(s+)?/>(s+)?'," ",bd) #去掉<br/> bd=re.sub('/'," ",bd) #替换/ data.append(bd.strip()) #去掉前后的空格 datalist.append(data) #把处理好的一部电影信息放入datalist print(datalist) return datalist #得到指定URL网页内容 def askURl(url): head={ #模拟浏览器头部信息,向豆瓣服务器发送请求 "User-Agent": "Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/78.0.3904.108 Safari/537.36" } #用户代理,表示告诉豆瓣服务器,我们是什么类型的机器 request=urllib.request.Request(url,headers=head) html="" try: response=urllib.request.urlopen(request) html=response.read().decode("utf-8") # print(html) except urllib.error.URLError as e: if hasattr(e,"code"): print(e.code) if hasattr(e,"reason"): print(e.reason) return html #3.保存数据 def saveData(savepath): print("save....") if __name__=="__main__": #当程序执行时 #调用函数 main()

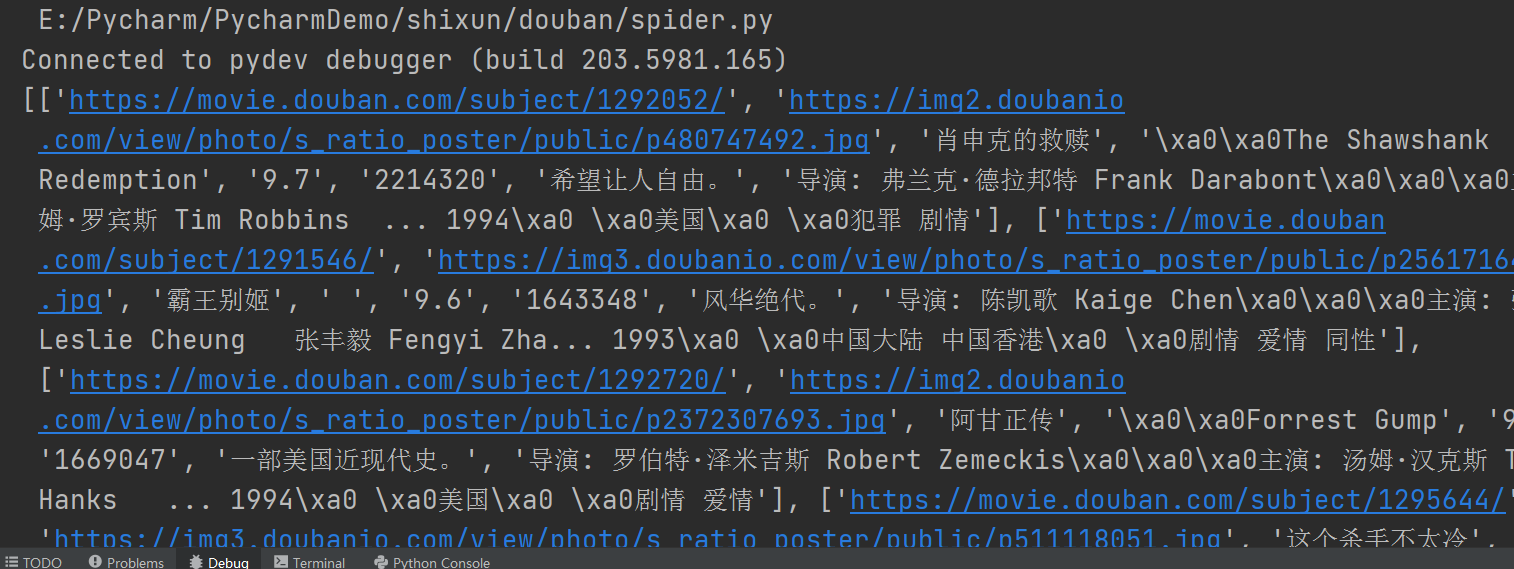

运行结果如下:

总结一下:

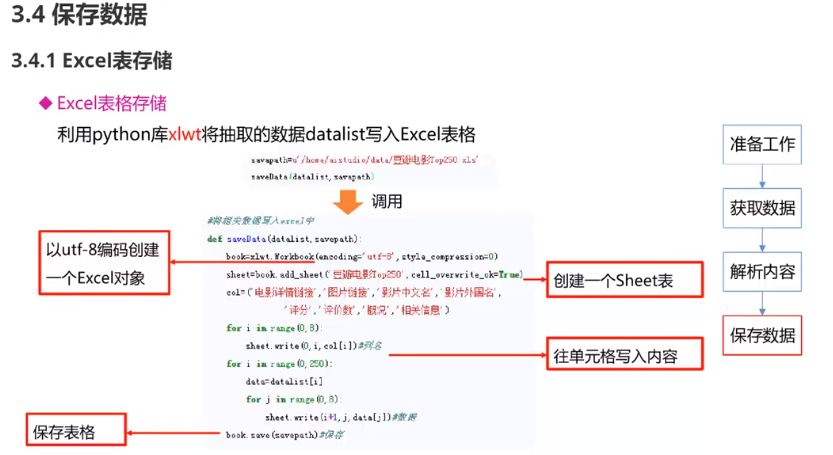

2.保存数据到excel

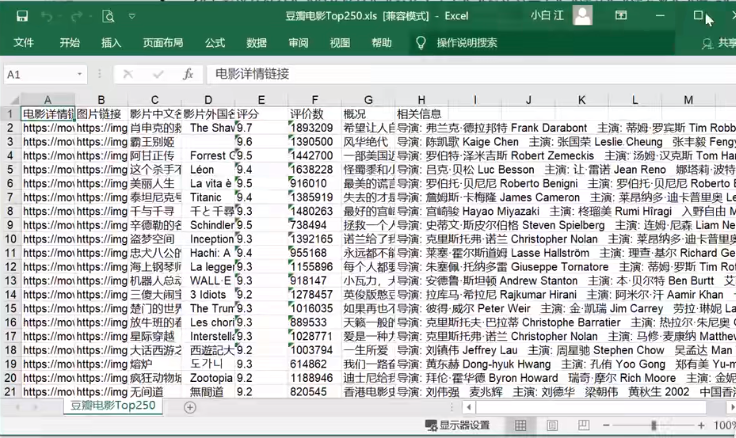

最终结果展示:

至此完成爬虫项目至excel中。

几点说明:1.当运行次数过多可能出现:Process finished with exit code 0,也没找到好的解决办法,要换个Ip可能有用;

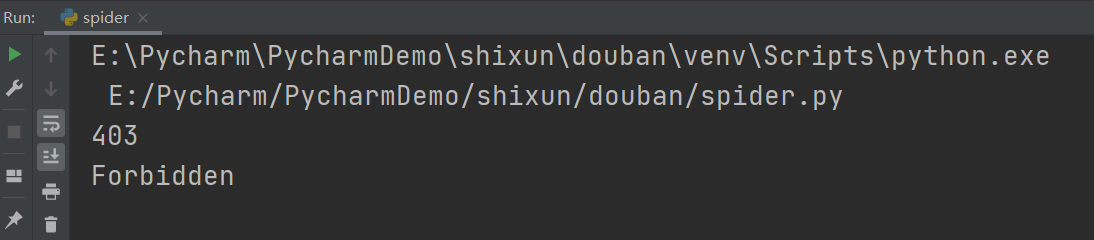

还可能代码运行如下,因为被禁止访问了。