1. soft-margin SVM的形式

其中ξn表示每个点允许的犯错程度(偏离margin有多远),但是犯错是有代价的,也就是目标函数里面要最小化的。c控制对犯错的容忍程度。

2. 推导soft SVM的对偶问题

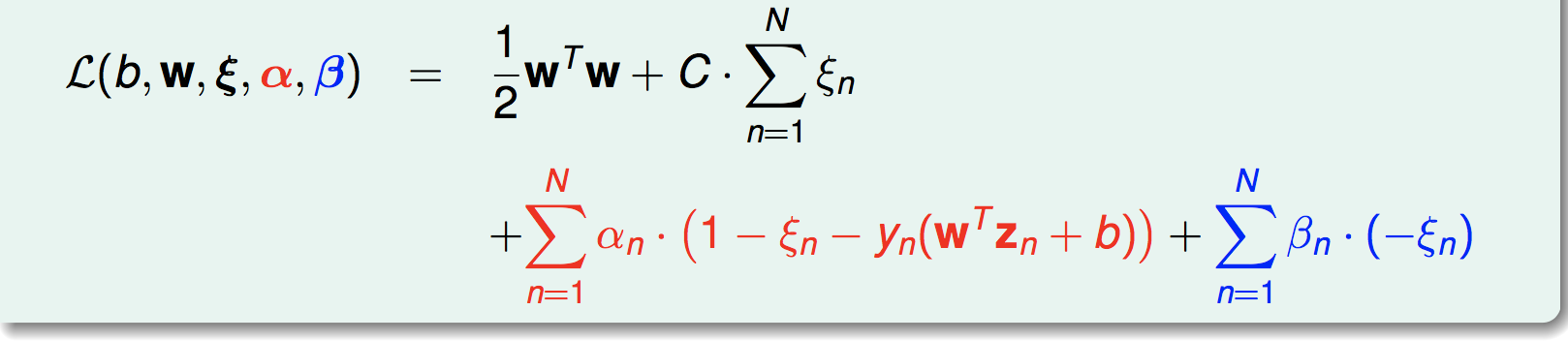

首先写出拉格朗日函数:

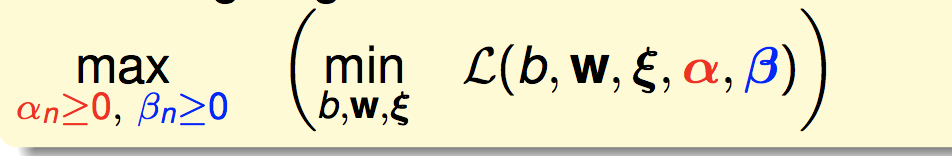

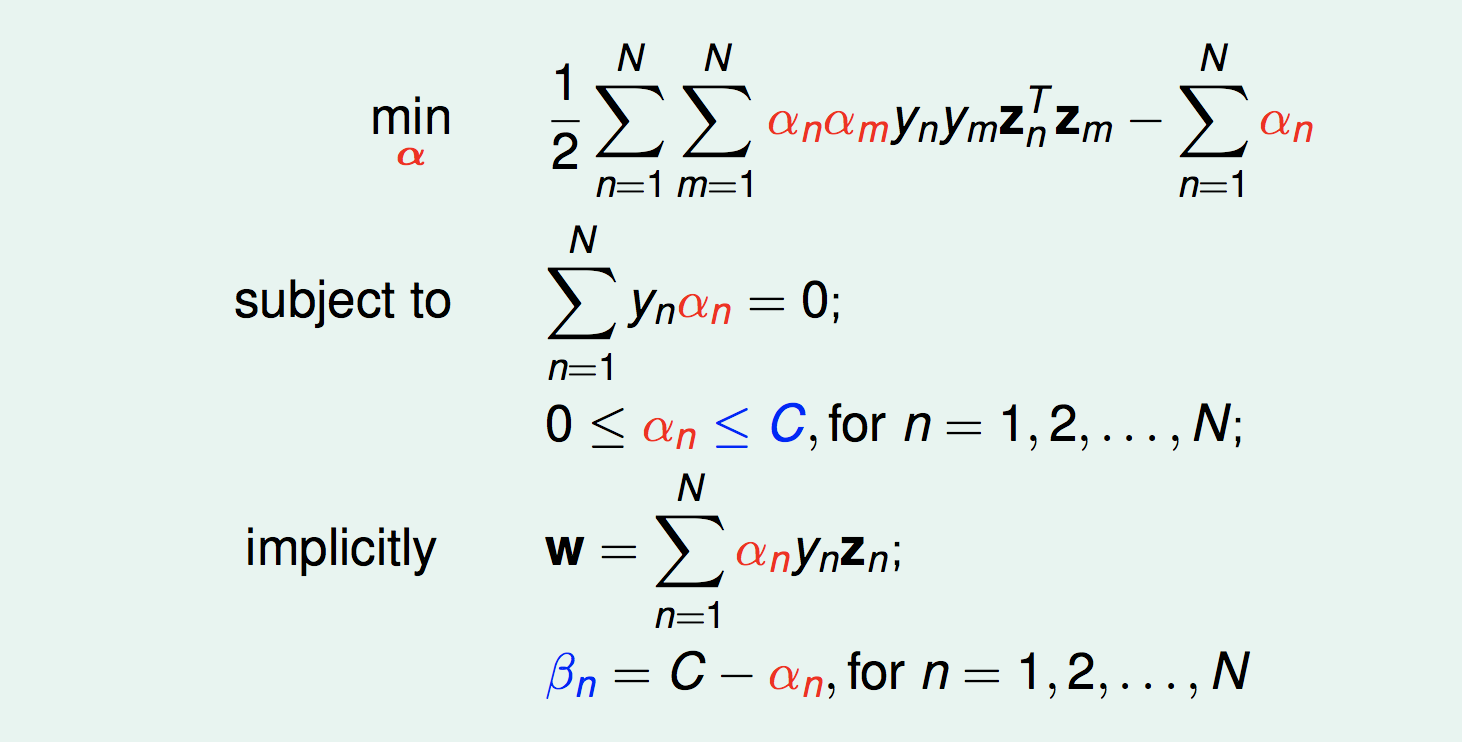

可以推导出对偶问题为:

即:

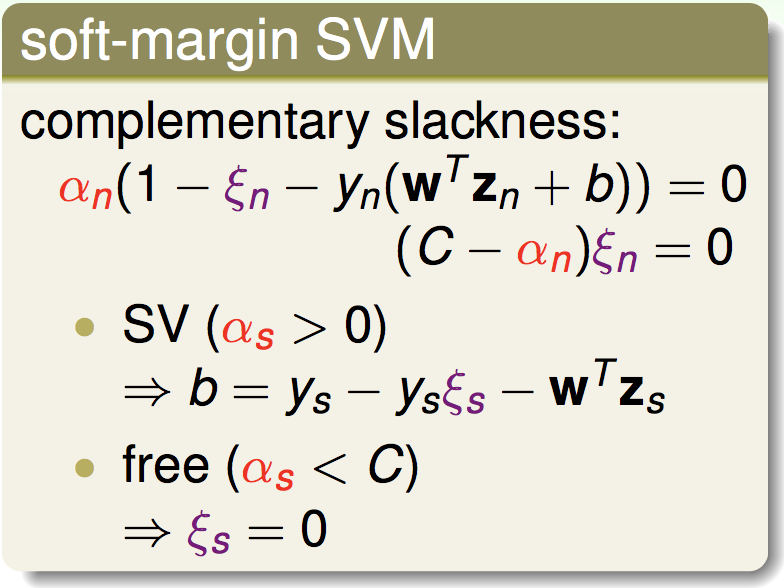

最优解满足KKT条件:

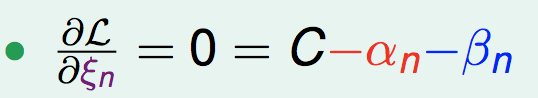

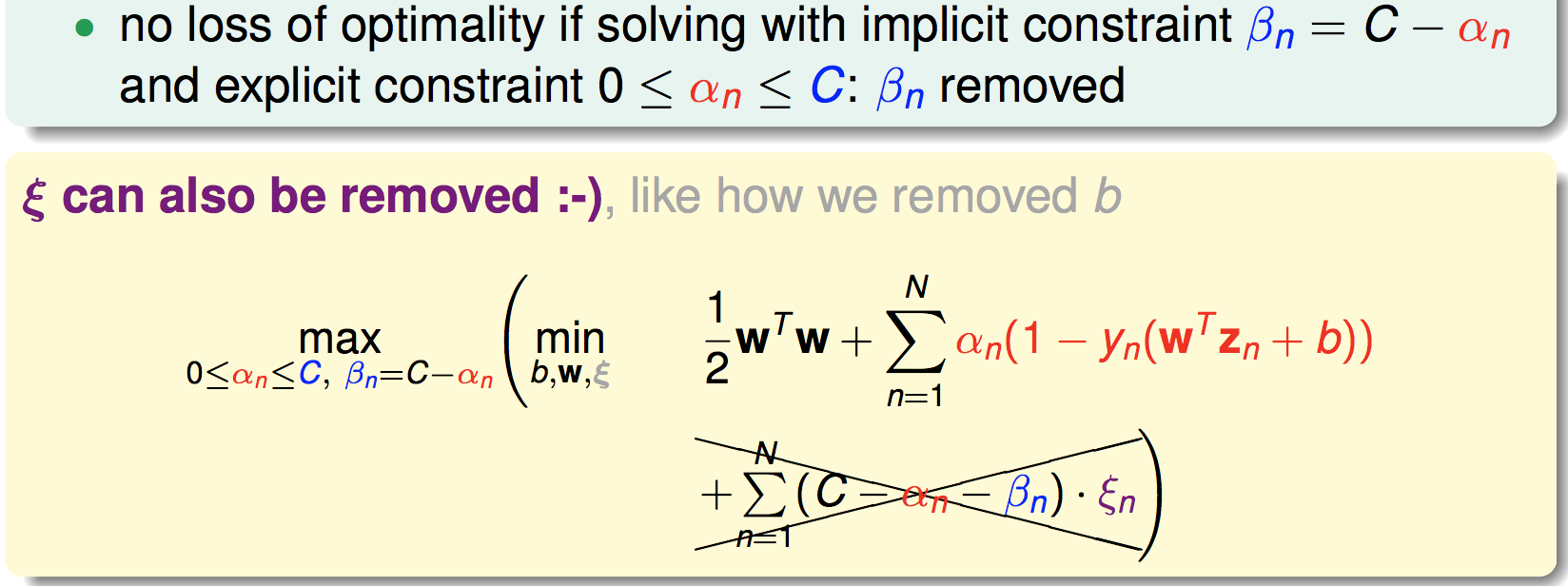

代入后可以将贝塔消去,ξ消去:

因此,对偶问题基本和原来相似:

3. 解 soft SVM问题

如何求b?需要找到阿尔法大于零小于C的那些向量,称为free向量:

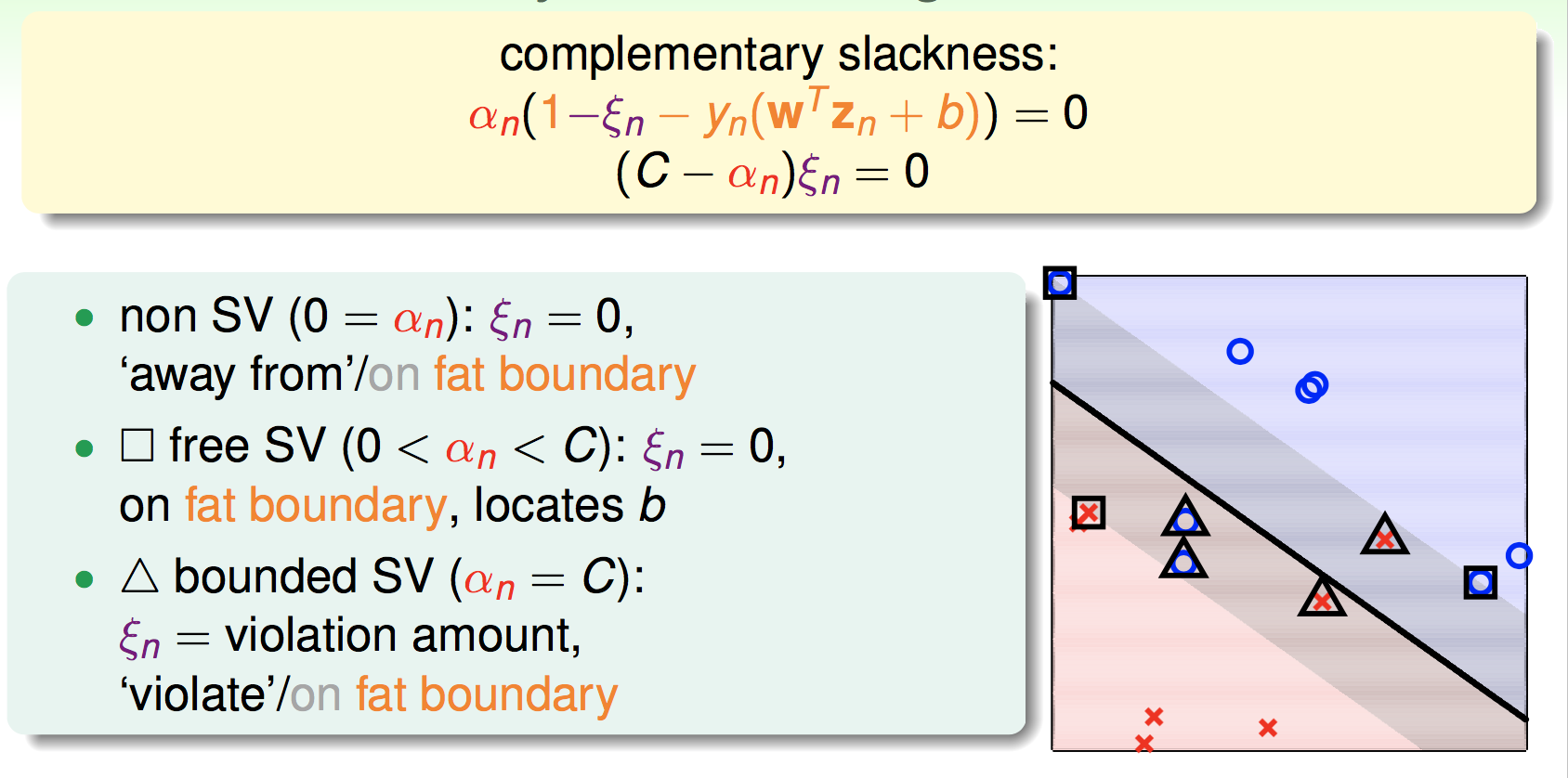

4. soft-margin SVM中的三类向量

5. SVM中的留一交叉验证

未完持续