1.操作系统内存划分:

a.早期Windows内存分配:

内存以page为单位,默认的page大小是4kB,按page来分的,一个page只能为一个程序服务

三大类:

程序所在空间--->RSS(常驻内存集)

文件所在空间--->page cache(页缓存)

匿名页

b.问题

内存碎片:对不同内存的需求,会产生内存碎片

寻址:寻找空闲页

早期是使用便利所有内存页的方式来寻找内存区域,这种方式是低效的

c.两大机制:

①.buddy system:内存管理子系统,回收内存碎片,清理内存(使一共LRU算法清理)

②.slab allocator

2.redis(大型集群)

下载:redis.io 官网

版本:发布版6个月以上

centos7 安装:

yum install redis

开启服务:redis-server &

启动: src/redis-server &(&后台运行)

后台启动:

设置远程访问:

bind 0.0.0.0

设置在后台运行redis,打开redis.conf,把daemonize设置为yes

daemonize yes

启动命令:/usr/bin/redis-server /etc/redis.conf

关闭命令:redis-cli shutdown

客户端连接测试:

src/redis-cli

set foo bar

get foo

特点:

高速读写

数据类型丰富*

数据持久化*

内存分配回收策略

事务

消息队列,消息订阅*

高可用

分布式集群

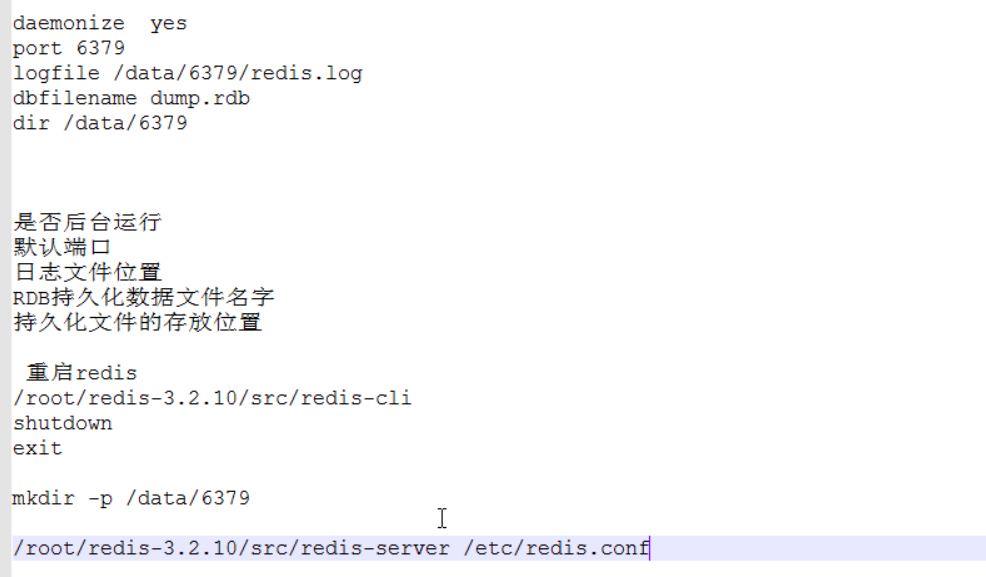

定制配置文件

vim /etc/redis.conf

是否后台运行: daemonize yes

默认端口: port 6379

日志文件位置 logfile /data/6379/redis.log

RDB持久化数据文件: dbfilename dump.rdb

持久化数据文件指定路径:dir /data/6379

关闭:

src/redis-cli

shutdown

配置环境变量

cd /root/

vim .bash_profile

export PATH=$PATH:/root/redis-3.2.10/src

source .bash_profile

redis 开启密码验证

vim /etc/redis.conf

添加:

requirepass 123456

关闭:

redis-cli

shutdown

exit

重启redis

redis-server /etc/redis.conf(加上配置文件)

登录:

方法一:

redis-cli -a 123456

方法二:

redis-cli

auth 123456

在线更改配置:

只在当前启动时生效,重启会读取配置文件后不生效

CONFIG set requirepass 123

3、redis持久化(***)

1、RDB:企业中一般使用此方式

镜像方式持久化,保存一个时间点的内存数据状态

1、不是实时的持久化,一段时间做一次内存镜像到磁盘

2、覆盖形式的持久化方式

3、一般这种方式的持久化用来做备份

4、持久化的数据可能不是完整的

人工触发持久化:

save

开启持久化:

dbfilename dump.rdb

dir /data/6379

配置:自动save

save 900 1

save 300 1

save 60 10000

配置分别表示:

• 900 秒( 15 分钟)内有 1 个更改

• 300 秒( 5 分钟)内有 10 个更改

• 60 秒内有 10000 个更改

当达到以上定义的配置时间时,就将内存数据持久化到磁盘

2、AOF:append only file(只追加文件)

对于安全性要求高的选择这个

记录Redis的每一条修改操作,到持久化文件中

1、可以是一个实时的持久化方式

2、追加形式持久化

3、持久化的数据可能是完整的

开启持久化:

appendonly no/yes:是否打开 aof 日志功能

appendfsync always:redis中有一个变化,就立即持久化一次,最安全的一种方式。

appendfsync everysec:每秒钟,持久化一次。性能较高但是有可能丢失1秒的数据。

appendfsync no:相当于不开启。

4、数据类型(详见pdf的29页)

• String:字符串数据类型

key:value

• Hash:哈希数据类型()常用,用作对象存储,比如将mysql相关的表存储到redis中

key id:1 name:xx age:19

表:表名:key

F1 F2 F3 列

id name age

1 xx 19

• List :列表

• Set:集合

• Sorted set:有序集合

5、全局Key操作

• KEYS * 查看KEY支持通配符

• DEL 删除给定的一个或多个key

• EXISTS 检查是否存在

• RENAME 变更KEY名

• SORT 键值排序,有非数字时报错

• TYPE 返回键所存储值的类型

• DUMP RESTORE 序例化与反序列化

• EXPIRE PEXPIRE 以秒微秒设定生存时间

• TTL PTTL 以秒微秒为单位返回生存时间

• PERSIST 取消生存实现设置

• RANDOMKEY 返回数据库中的任意键

6、相应数据类型的操作

Str: 常规计数应用

set

get

incr

decr

incrby

decrby

mset

mget

——————————————————————————————

增

set mykey "test" 为键设置新值,并覆盖原有值

getset mycounter 0 设置值,取值同时进行

setex mykey 10 "hello" 设置指定 Key 的过期时间为10秒,在存活时间可以获取value

setnx mykey "hello" 若该键不存在,则为键设置新值

mset key3 "zyx" key4 "xyz" 批量设置键

删

del mykey 删除已有键

改

append mykey "hello" 若该键并不存在,返回当前 Value 的长度

该键已经存在,返回追加后 Value的长度

incr mykey 值增加1,若该key不存在,创建key,初始值设为0,增加后结果为1

decrby mykey 5 值减少5

setrange mykey 20 dd 把第21和22个字节,替换为dd, 超过value长度,自动补0

查

exists mykey 判断该键是否存在,存在返回 1,否则返回0

get mykey 获取Key对应的value

strlen mykey 获取指定 Key 的字符长度

ttl mykey 查看一下指定 Key 的剩余存活时间(秒数)

getrange mykey 1 20 获取第2到第20个字节,若20超过value长度,则截取第2个和后面所有的

mget key3 key4 批量获取键

---------------------

hash(字典):用作对象存储,比如需要将mysql相关的表存储到redis中。

hmset

hgetall

——————————————————————————————————

增

hset myhash field1 "s"

若字段field1不存在,创建该键及与其关联的Hashes, Hashes中,key为field1 ,并设value为s ,若存在会覆盖原value

hsetnx myhash field1 s

若字段field1不存在,创建该键及与其关联的Hashes, Hashes中,key为field1 ,并设value为s, 若字段field1存在,则无效

hmset myhash field1 "hello" field2 "world 一次性设置多个字段

删

hdel myhash field1 删除 myhash 键中字段名为 field1 的字段

del myhash 删除键

改

hincrby myhash field 1 给field的值加1

查

hget myhash field1 获取键值为 myhash,字段为 field1 的值

hlen myhash 获取myhash键的字段数量

hexists myhash field1 判断 myhash 键中是否存在字段名为 field1 的字段

hmget myhash field1 field2 field3 一次性获取多个字段

hgetall myhash 返回 myhash 键的所有字段及其值

hkeys myhash 获取myhash 键中所有字段的名字

hvals myhash 获取 myhash 键中所有字段的值

——————————————————————————————————————————————————————————————————————

LIST(列表)

应用场景

消息队列系统

比如sina微博:

在Redis中我们的最新微博ID使用了常驻缓存,这是一直更新的。但

是做了限制不能超过5000个ID,因此获取ID的函数会一直询问Redis。

只有在start/count参数超出了这个范围的时候,才需要去访问数据库。

系统不会像传统方式那样“刷新”缓存,Redis实例中的信息永远是一致的。

SQL数据库(或是硬盘上的其他类型数据库)只是在用户需要获取“很远”的数据时才会被触发,

而主页或第一个评论页是不会麻烦到硬盘上的数据库了。

-------------------

增

lpush mykey a b 若key不存在,创建该键及与其关联的List,依次插入a ,b, 若List类型的key存在,则插入value中

lpushx mykey2 e 若key不存在,此命令无效, 若key存在,则插入value中

linsert mykey before a a1 在 a 的前面插入新元素 a1

linsert mykey after e e2 在e 的后面插入新元素 e2

rpush mykey a b 在链表尾部先插入b,在插入a

rpushx mykey e 若key存在,在尾部插入e, 若key不存在,则无效

rpoplpush mykey mykey2 将mykey的尾部元素弹出,再插入到mykey2 的头部(原子性的操作)

删

del mykey 删除已有键

lrem mykey 2 a 从头部开始找,按先后顺序,值为a的元素,删除数量为2个,若存在第3个,则不删除

改

ltrim mykey 0 2 从头开始,索引为0,1,2的3个元素,其余全部删除

lset mykey 1 e 从头开始, 将索引为1的元素值,设置为新值 e,若索引越界,则返回错误信息

rpoplpush mykey mykey 将 mykey 中的尾部元素移到其头部

查

lrange mykey 0 -1 取链表中的全部元素,其中0表示第一个元素,-1表示最后一个元素。

lrange mykey 0 2 从头开始,取索引为0,1,2的元素

lrange mykey 0 0 从头开始,取第一个元素,从第0个开始,到第0个结束

lpop mykey 获取头部元素,并且弹出头部元素,出栈

lindex mykey 6 从头开始,获取索引为6的元素 若下标越界,则返回nil

--------------------------

SET(集合)

应用场景:

案例:?

在微博应用中,可以将一个用户所有的关注人存在一个集合中,将其所有粉丝存在一个集合。

Redis还为集合提供了求交集、并集、差集等操作,可以非常方便的实现如共同关注、共同喜好、二度好友等功能,

对上面的所有集合操作,你还可以使用不同的命令选择将结果返回给客户端还是存集到一个新的集合中。

sadd

smembers

sdiff[store]

SINTER[store]

sunion[store]

-----------------

增

sadd myset a b c

若key不存在,创建该键及与其关联的set,依次插入a ,b,若key存在,则插入value中,若a 在myset中已经存在,则插入了 d 和 e 两个新成员。

删

spop myset 尾部的b被移出,事实上b并不是之前插入的第一个或最后一个成员

srem myset a d f 若f不存在, 移出 a、d ,并返回2

改

smove myset myset2 a 将a从 myset 移到 myset2,

查

sismember myset a 判断 a 是否已经存在,返回值为 1 表示存在。

smembers myset 查看set中的内容

scard myset 获取Set 集合中元素的数量

srandmember myset 随机的返回某一成员

sdiff myset1 myset2 myset3 1和2得到一个结果,拿这个集合和3比较,获得每个独有的值

sdiffstore diffkey myset myset2 myset3 3个集和比较,获取独有的元素,并存入diffkey 关联的Set中

sinter myset myset2 myset3 获得3个集合中都有的元素

sinterstore interkey myset myset2 myset3 把交集存入interkey 关联的Set中

sunion myset myset2 myset3 获取3个集合中的成员的并集

sunionstore unionkey myset myset2 myset3 把并集存入unionkey 关联的Set中

------------------

sort set:有序集合

应用场景:

排行榜应用,取TOP N操作?

这个需求与上面需求的不同之处在于,前面操作以时间为权重,这个是以某个条件为权重,

比如按顶的次数排序,这时候就需要我们的sorted set出马了,将你要排序的值设置成sorted set的score,

将具体的数据设置成相应的value,每次只需要执行一条ZADD命令即可。

zadd salary 10000 alex 20000 wusir

zrange salary 0 -1 WITHSCORES

ZREVRANGE salary 0 999 withscores

--------------

增

zadd myzset 2 "two" 3 "three" 添加两个分数分别是 2 和 3 的两个成员

删

zrem myzset one two 删除多个成员变量,返回删除的数量

改

zincrby myzset 2 one 将成员 one 的分数增加 2,并返回该成员更新后的分数

查

zrange myzset 0 -1 WITHSCORES 返回所有成员和分数,不加WITHSCORES,只返回成员

zrank myzset one 获取成员one在Sorted-Set中的位置索引值。0表示第一个位置

zcard myzset 获取 myzset 键中成员的数量

zcount myzset 1 2 获取分数满足表达式 1 <= score <= 2 的成员的数量

zscore myzset three 获取成员 three 的分数

zrangebyscore myzset 1 2 获取分数满足表达式 1 < score <= 2 的成员

#-inf 表示第一个成员,+inf最后一个成员

#limit限制关键字

#2 3 是索引号

zrangebyscore myzset -inf +inf limit 2 3 返回索引是2和3的成员

zremrangebyscore myzset 1 2 删除分数 1<= score <= 2 的成员,并返回实际删除的数量

zremrangebyrank myzset 0 1 删除位置索引满足表达式 0 <= rank <= 1 的成员

zrevrange myzset 0 -1 WITHSCORES 按位置索引从高到低,获取所有成员和分数

#原始成员:位置索引从小到大

one 0

two 1

#执行顺序:把索引反转

位置索引:从大到小

one 1

two 0

#输出结果: two

one

zrevrange myzset 1 3 获取位置索引,为1,2,3的成员

#相反的顺序:从高到低的顺序

zrevrangebyscore myzset 3 0 获取分数 3>=score>=0的成员并以相反的顺序输出

zrevrangebyscore myzset 4 0 limit 1 2 获取索引是1和2的成员,并反转位置索引

-----------

7、主从复制

原理:基于RDB持久化的特性,但不是非得开启持久化才能使用,从库会实时去主库请求RDB快照文件

搭建过程:

1、准备节点(或多redis实例)

mkdir -p /data/638{0,1,2}

---------------------------

vim /data/6380/redis.conf

port 6380

daemonize yes

pidfile /data/6380/redis.pid

loglevel notice

logfile "/data/6380/redis.log"

dbfilename dump.rdb

dir /data/6380

------------------------------

vim /data/6381/redis.conf

port 6381

daemonize yes

pidfile /data/6381/redis.pid

loglevel notice

logfile "/data/6381/redis.log"

dbfilename dump.rdb

dir /data/6381

----------------------

vim /data/6382/redis.conf

port 6382

daemonize yes

pidfile /data/6382/redis.pid

loglevel notice

logfile "/data/6382/redis.log"

dbfilename dump.rdb

dir /data/6382

启动:

redis-server /data/6380/redis.conf

redis-server /data/6381/redis.conf

redis-server /data/6382/redis.conf

查看启动状态:netstat -lnp|grep 638

2、开启主从:

分别6381/6382命令行:

redis-cli -p 6381

SLAVEOF 127.0.0.1 6380

redis-cli -p 6382

SLAVEOF 127.0.0.1 6380

info replication :查看信息

slaveof no one :设为主库

3、Sentinel 是一个监视器,它可以根据被监视实例的身份和状态来判断应该执 行何种动作

1、监控所有的节点redis状态

2、自动选择新的主库,并切换(slaveof no one)

3、剩余从库,和新主库开启主从复制,(SLAVEOF 127.0.0.1 6381)

4、通知客户端程序,工作节点发生变化了

配置:

mkdir /data/26380

cd /data/26380

vim /data/26380/sentinel.conf

配置文件添加以下内容:

port 26380

dir "/tmp"

sentinel monitor mymaster 127.0.0.1 6380 1

sentinel down-after-milliseconds mymaster 60000

sentinel config-epoch mymaster 0

启动

redis-sentinel /data/26380/sentinel.conf &

8、Redis Cluster

EPEL源安装ruby支持

yum install ruby rubygems -y

gem sources -a http://mirrors.aliyun.com/rubygems/

gem sources --remove http://rubygems.org/

gem sources -l

安装:

gem install redis -v 3.3.3

准备节点:

----------------------

mkdir -p /data/700{0,1,2,3,4,5}

---------------------------

vim /data/7000/redis.conf

port 7000

daemonize yes

pidfile /data/7000/redis.pid

loglevel notice

logfile "/data/7000/redis.log"

dbfilename dump.rdb

dir /data/7000

cluster-enabled yes

cluster-config-file nodes.conf

cluster-node-timeout 5000

appendonly yes

------------------------------

vim /data/7001/redis.conf

port 7001

daemonize yes

pidfile /data/7001/redis.pid

loglevel notice

logfile "/data/7001/redis.log"

dbfilename dump.rdb

dir /data/7001

cluster-enabled yes

cluster-config-file nodes.conf

cluster-node-timeout 5000

appendonly yes

----------------------

vim /data/7002/redis.conf

port 7002

daemonize yes

pidfile /data/7002/redis.pid

loglevel notice

logfile "/data/7002/redis.log"

dbfilename dump.rdb

dir /data/7002

cluster-enabled yes

cluster-config-file nodes.conf

cluster-node-timeout 5000

appendonly yes

---------------------------

vim /data/7003/redis.conf

port 7003

daemonize yes

pidfile /data/7003/redis.pid

loglevel notice

logfile "/data/7003/redis.log"

dbfilename dump.rdb

dir /data/7003

cluster-enabled yes

cluster-config-file nodes.conf

cluster-node-timeout 5000

appendonly yes

------------------------------

vim /data/7004/redis.conf

port 7004

daemonize yes

pidfile /data/7004/redis.pid

loglevel notice

logfile "/data/7004/redis.log"

dbfilename dump.rdb

dir /data/7004

cluster-enabled yes

cluster-config-file nodes.conf

cluster-node-timeout 5000

appendonly yes

----------------------

vim /data/7005/redis.conf

port 7005

daemonize yes

pidfile /data/7005/redis.pid

loglevel notice

logfile "/data/7005/redis.log"

dbfilename dump.rdb

dir /data/7005

cluster-enabled yes

cluster-config-file nodes.conf

cluster-node-timeout 5000

appendonly yes

启动:

redis-server /data/7000/redis.conf

redis-server /data/7001/redis.conf

redis-server /data/7002/redis.conf

redis-server /data/7003/redis.conf

redis-server /data/7004/redis.conf

redis-server /data/7005/redis.conf

启动集群:

redis-trib.rb create --replicas 1 127.0.0.1:7000 127.0.0.1:7001 127.0.0.1:7002 127.0.0.1:7003 127.0.0.1:7004 127.0.0.1:7005

Redis常见问题:

1.什么是redis?

Redis 是一个基于内存的高性能key-value数据库。支持python的四种数据类型

2.使用redis有哪些好处?

(1) 速度快,因为数据存在内存中

(2) 支持丰富数据类型,支持string,list,set,sorted set,hash

(3) 支持事务,操作都是原子性,所谓的原子性就是对数据的更改要么全部执行,要么全部不执行

(4) 丰富的特性:可用于缓存,消息,按key设置过期时间,过期后将会自动删除

3.redis相比memcached有哪些优势?

(1) memcached所有的值均是简单的字符串,redis作为其替代者,支持更为丰富的数据类型

(2) redis的速度比memcached快很多

(3) redis可以持久化其数据

4.Memcache与Redis的区别都有哪些?

1)、存储方式

Memecache把数据全部存在内存之中,断电后会挂掉,数据不能超过内存大小。

Redis有部份存在硬盘上,这样能保证数据的持久性。

2)、数据支持类型

Memcache对数据类型支持相对简单。

Redis有复杂的数据类型。

3)value大小

redis最大可以达到1GB,而memcache只有1MB

5.redis常见性能问题和解决方案:

(1) Master最好不要做任何持久化工作,如RDB内存快照和AOF日志文件

(2) 如果数据比较重要,某个Slave开启AOF备份数据,策略设置为每秒同步一次

(3) 为了主从复制的速度和连接的稳定性,Master和Slave最好在同一个局域网内

(4) 尽量避免在压力很大的主库上增加从库

(5) 主从复制不要用图状结构,用单向链表结构更为稳定,即:Master <- Slave1 <- Slave2 <- Slave3...

这样的结构方便解决单点故障问题,实现Slave对Master的替换。如果Master挂了,可以立刻启用Slave1做Master,其他不变。

6. mySQL里有2000w数据,redis中只存20w的数据,如何保证redis中的数据都是热点数据

相关知识:redis 内存数据集大小上升到一定大小的时候,就会施行数据淘汰策略(回收策略)。

redis 提供 6种数据淘汰策略:

volatile-lru:从已设置过期时间的数据集(server.db[i].expires)中挑选最近最少使用的数据淘汰

volatile-ttl:从已设置过期时间的数据集(server.db[i].expires)中挑选将要过期的数据淘汰

volatile-random:从已设置过期时间的数据集(server.db[i].expires)中任意选择数据淘汰

allkeys-lru:从数据集(server.db[i].dict)中挑选最近最少使用的数据淘汰

allkeys-random:从数据集(server.db[i].dict)中任意选择数据淘汰

no-enviction(驱逐):禁止驱逐数据

7.redis持久化的几种方式?

RDB持久化

AOF持久化