可以参考这篇文章:

https://zhuanlan.zhihu.com/p/36711903

《BP 神经网络 —— 逆向传播的艺术》

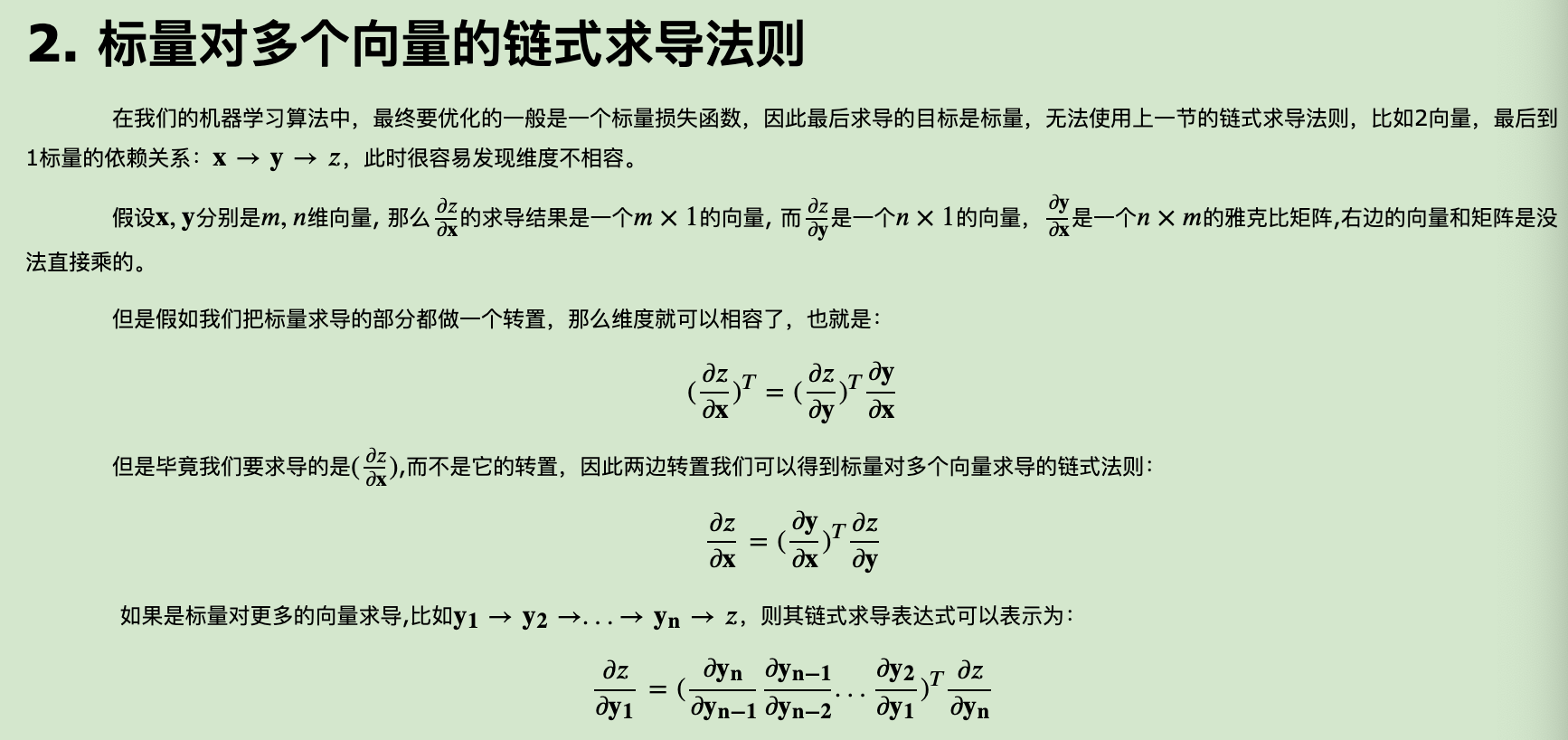

里面有一些重要的知识点:

神经网络的前馈 (forward propagation) 过程,前馈过程也非常容易理解,符合人正常的逻辑,具体的矩阵计算表达如下:

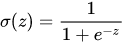

这里就是sigmoid函数的求导结果

这里就是sigmoid函数的求导结果

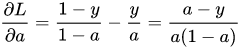

开始通过链式法则求 :

继续,可求得:

根据梯度下降法,可迭代更新这两个参数值:

续逆向传播的过程,开始计算再前面一层

其中,,

注意:上面式子涉及到向量维度,可以理解为链式法则里面左侧的维度和右侧的维度是保持一致的。

可以参考这篇文章:https://www.cnblogs.com/pinard/p/10825264.html

求得 之后,可方便地分别求得输入层至隐含层中

和

的导数:

同样的,根据梯度下降法对参数 和

进行更新:

另外注意:BP的一个很重要的优化点就是,后一层计算结果可以直接被前一层进行复用, 而不需要重复计算。