函数运用:

backward() 如果需要计算导数,可以在Tensor上调.backward(); backward(gradient=None, retain_variables=False)[sound] 如果Tensor是标量(即它包含一个元素的数据),则不需要为backward()指定任何参数

x.grad.zero_() 在使用pytorch实现多项线性回归中,在grad更新时,每一次运算后都需要将上一次的梯度记录清空

多层感知机:

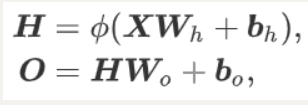

多层感知机就是含有至少一个隐藏层的由全连接层组成的神经网络,且每个隐藏层的输出通过激活函数进行变换。

多层感知机的层数和各隐藏层中隐藏单元个数都是超参数

Ф表示激活函数

Sequential 模型

Sequential模型字面上的翻译是顺序模型,给人的第一感觉是那种简单的线性模型,但实际上Sequential模型可以构建非常复杂的神经网络,包括全连接神经网络、卷积神经网络(CNN)、循环神经网络(RNN)、等等。这里的Sequential更准确的应该理解为堆叠