直接开始!

环境: python 2.7 + win10

工具:fiddler postman 安卓模拟器

首先,打开fiddler,fiddler作为http/https 抓包神器,这里就不多介绍。

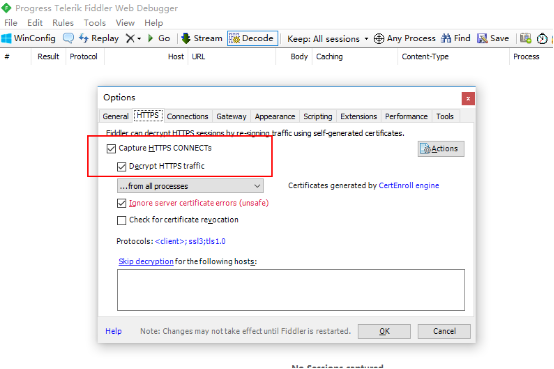

配置允许https

配置允许远程连接 也就是打开http代理

电脑ip: 192.168.1.110

然后 确保手机和电脑是在一个局域网下,可以通信。由于我这边没有安卓手机,就用了安卓模拟器代替,效果一样的。

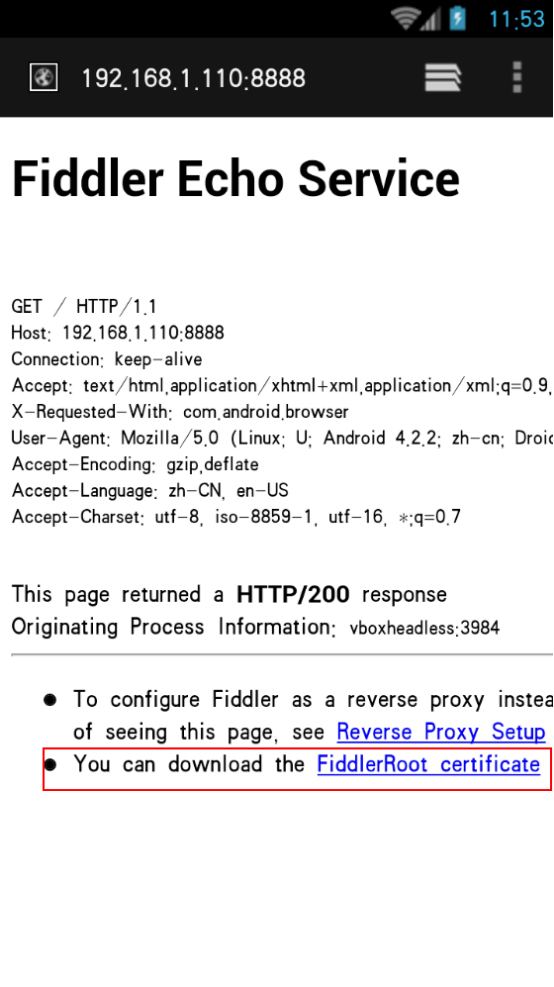

打开手机浏览器,输入192.168.1.110:8888 也就是设置的代理地址,安装证书之后才能抓包

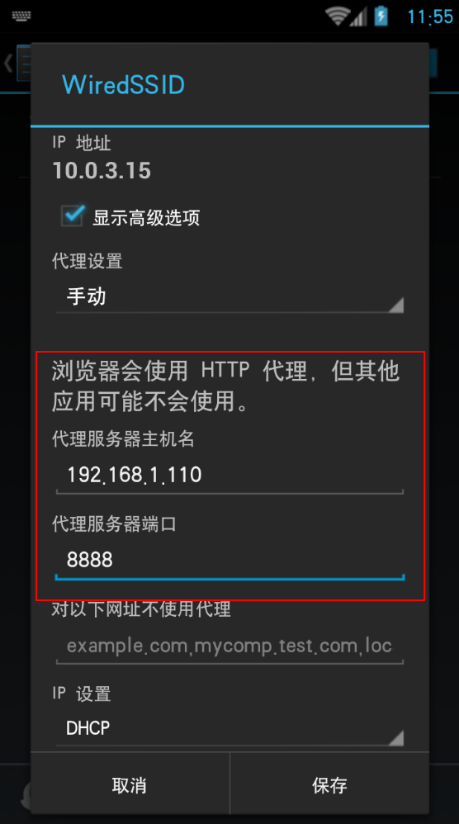

安装证书之后,在WiFi设置 修改网络 手动指定http代理

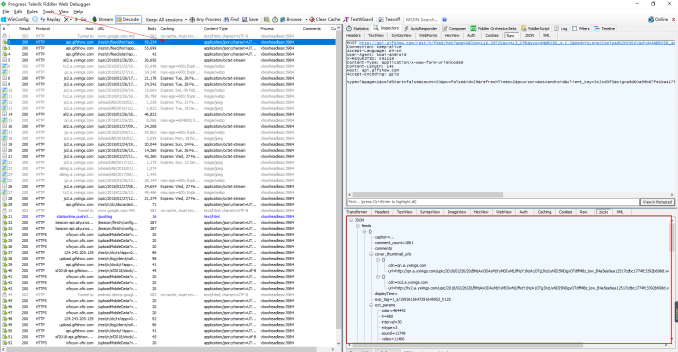

保存后就可以了,fiddler就可以抓到app的数据了,打开快手 刷新,可以 看到有很多http请求进来,一般接口地址之类的很明显的,可以看到 是json类型的

http post请求,返回数据是json ,展开后发现一共是20条视频信息,先确保是否正确,找一个视频链接看下。

ok 是可以播放的 很干净也没有水印。

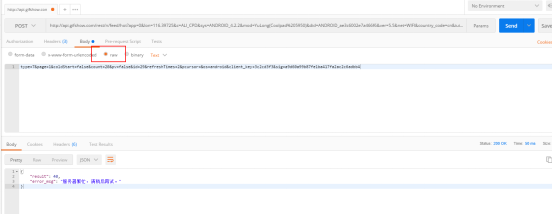

那就打开postman 来测试,form-data 方式提交则报错

那换raw 这种

报错信息不一样了,试试加上headers

nice 成功返回数据,我又多试几次,发现每次返回结果不一样,都是20个视频,刚才其中post参数中 有个page=1 这样一直都是第一页 就像一直在手机上不往下翻了 就开始一直刷新那样,反正 也无所谓,只要返回数据 不重复就好。

下面就开始上代码

1 # -*-coding:utf-8-*- 2 # author : Corleone 3 import urllib2,urllib 4 import json,os,re,socket,time,sys 5 import Queue 6 import threading 7 import logging 8 9 10 # 日志模块 11 logger = logging.getLogger("AppName") 12 formatter = logging.Formatter('%(asctime)s %(levelname)-5s: %(message)s') 13 console_handler = logging.StreamHandler(sys.stdout) 14 console_handler.formatter = formatter 15 logger.addHandler(console_handler) 16 logger.setLevel(logging.INFO) 17 18 19 video_q = Queue.Queue() # 视频队列 20 21 22 def get_video(): 23 url = "http://101.251.217.210/rest/n/feed/hot?app=0&lon=121.372027&c=BOYA_BAIDU_PINZHUAN&sys=ANDROID_4.1.2&mod=HUAWEI(HUAWEI%20C8813Q)&did=ANDROID_e0e0ef947bbbc243&ver=5.4&net=WIFI&country_code=cn&iuid=&appver=5.4.7.5559&max_memory=128&oc=BOYA_BAIDU_PINZHUAN&ftt=&ud=0&language=zh-cn&lat=31.319303 " 24 data = { 25 'type': 7, 26 'page': 2, 27 'coldStart': 'false', 28 'count': 20, 29 'pv': 'false', 30 'id': 5, 31 'refreshTimes': 4, 32 'pcursor': 1, 33 'os': 'android', 34 'client_key': '3c2cd3f3', 35 'sig': '22769f2f5c0045381203fc57d1b5ad9b' 36 } 37 req = urllib2.Request(url) 38 req.add_header("User-Agent", "kwai-android") 39 req.add_header("Content-Type", "application/x-www-form-urlencoded") 40 params = urllib.urlencode(data) 41 try: 42 html = urllib2.urlopen(req, params).read() 43 except urllib2.URLError: 44 logger.warning(u"网络不稳定 正在重试访问") 45 html = urllib2.urlopen(req, params).read() 46 result = json.loads(html) 47 reg = re.compile(u"[u4e00-u9fa5]+") # 只匹配中文 48 for x in result['feeds']: 49 try: 50 title = x['caption'].replace(" ","") 51 name = " ".join(reg.findall(title)) 52 video_q.put([name, x['photo_id'], x['main_mv_urls'][0]['url']]) 53 except KeyError: 54 pass 55 56 def download(video_q): 57 path = u"D:快手" 58 while True: 59 data = video_q.get() 60 name = data[0].replace(" ","") 61 id = data[1] 62 url = data[2] 63 file = os.path.join(path, name + ".mp4") 64 logger.info(u"正在下载:%s" %name) 65 try: 66 urllib.urlretrieve(url,file) 67 except IOError: 68 file = os.path.join(path, u"神经病呀"+ '%s.mp4') %id 69 try: 70 urllib.urlretrieve(url, file) 71 except (socket.error,urllib.ContentTooShortError): 72 logger.warning(u"请求被断开,休眠2秒") 73 time.sleep(2) 74 urllib.urlretrieve(url, file) 75 76 logger.info(u"下载完成:%s" % name) 77 video_q.task_done() 78 79 80 def main(): 81 # 使用帮助 82 try: 83 threads = int(sys.argv[1]) 84 except (IndexError, ValueError): 85 print u" 用法: " + sys.argv[0] + u" [线程数:10] " 86 print u"例如:" + sys.argv[0] + " 10" + u" 爬取视频 开启10个线程 每天爬取一次 一次2000个视频左右(空格隔开)" 87 return False 88 # 判断目录 89 if os.path.exists(u'D:快手') == False: 90 os.makedirs(u'D:快手') 91 # 解析网页 92 logger.info(u"正在爬取网页") 93 for x in range(1,100): 94 logger.info(u"第 %s 次请求" % x) 95 get_video() 96 num = video_q.qsize() 97 logger.info(u"共 %s 视频" %num) 98 # 多线程下载 99 for y in range(threads): 100 t = threading.Thread(target=download,args=(video_q,)) 101 t.setDaemon(True) 102 t.start() 103 104 video_q.join() 105 logger.info(u"-----------全部已经爬取完成---------------") 106 107 108 main()

下面测试

多线程下载 每次下载2000 个视频左右 默认下载到D:快手

总结:其实我这次爬的快手有点投机取巧了,因为post过去的参数 sign 是签名 的确是有加密的,只所以还能返回数据 那是因为我每次都是请求的一样的链接 page=1 都是第一页的 当我改成2的时候,就验签失败了。然而,它刚好这样也能返回不同的数据,虽然达到了效果,但却没有能破解他的加密算法。。。前两天 爬抖音的时候 也是这样。加密的。。。哎 。技术有限。。逆向不了他的app。。。等以后 有能力搞定了 在来分享吧。。

最后放上我的github地址 : https://github.com/binglansky/spider 也是刚注册的,之前都没提交过代码,也有几个其他的小爬虫,后期找到好玩的 有意思的都会提交上去 。 欢迎学习交流 玩耍 : ) 嘿嘿嘿~