1.用Hive对爬虫大作业产生的文本文件(或者英文词频统计下载的英文长篇小说)进行词频统计。

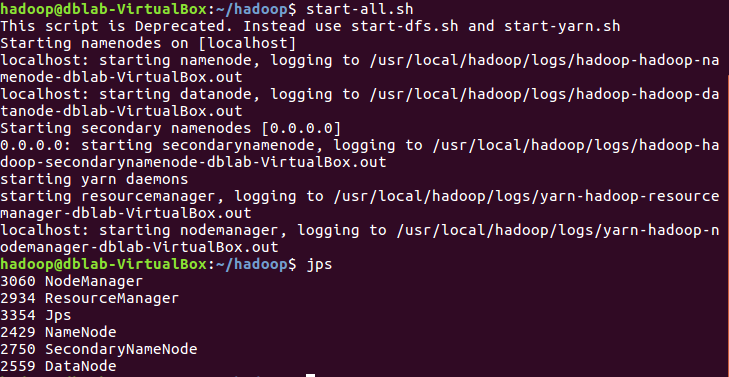

启动hadoop:

查看hdfs上的文件夹:

将本地系统hadoop文件夹里的英文版故事LittlePrince.txt上传至hdfs的hive文件夹中:

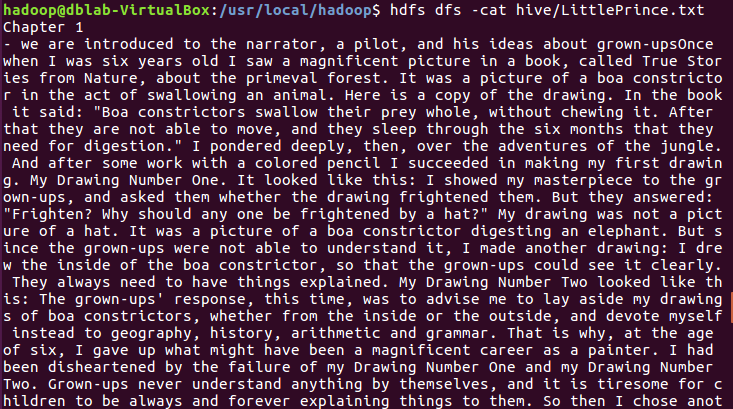

查看hdfs上的LittlePrince.txt文件内容:

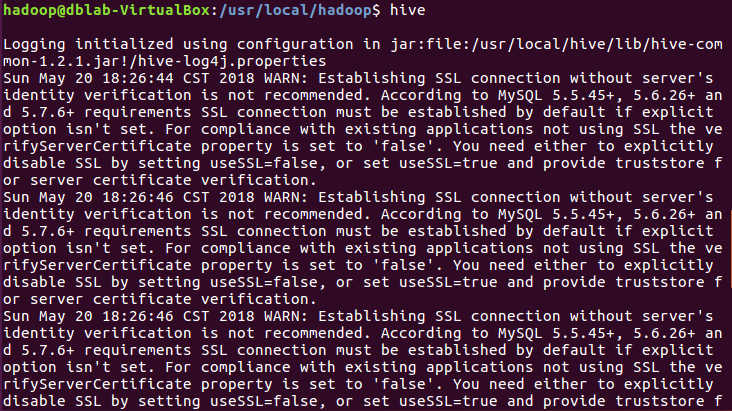

启动hive:

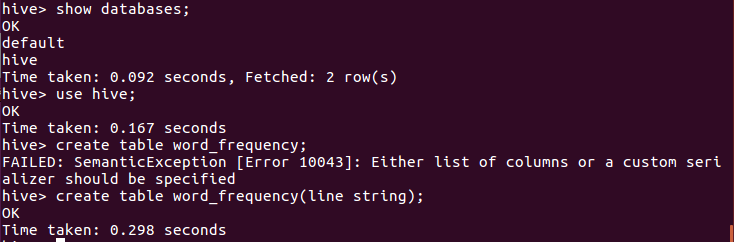

创建文档表word_frequency:

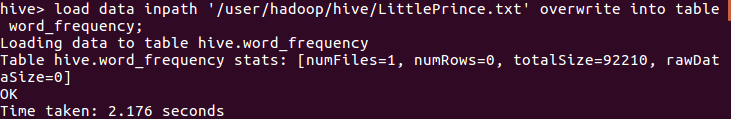

导入文件内容到表word_frequency:

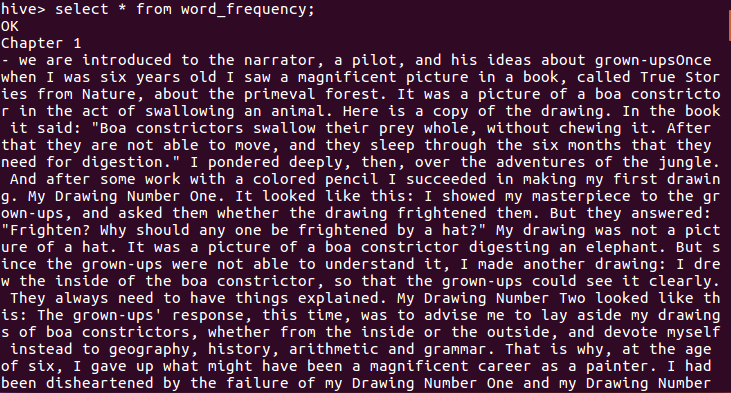

查看表word_frequency里的内容(总共27章):

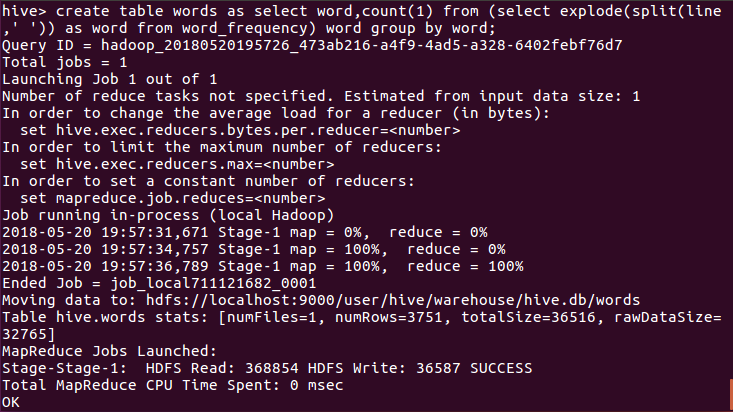

用HQL进行词频统计,结果放在表words里:

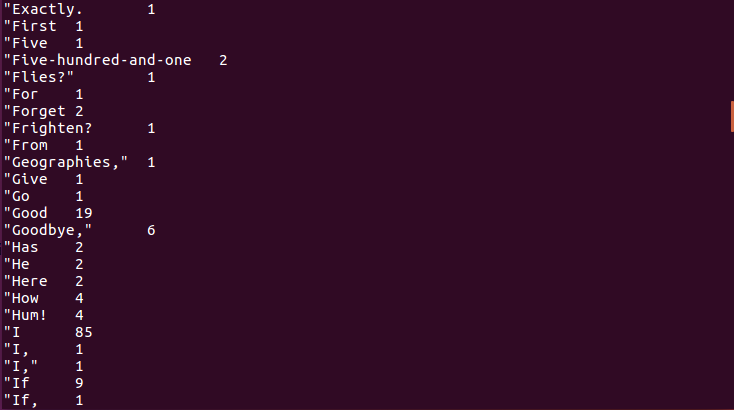

查看统计结果(总共3751 row(s)):

2.用Hive对爬虫大作业产生的csv文件进行数据分析,写一篇博客描述你的分析过程和分析结果。

先把爬取的文件上传到邮箱,然后在虚拟机上下载并放到本地的hadoop文件中并启动hadoop:

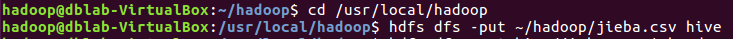

将本地系统hadoop文件夹里的jieba.csv上传至hdfs的hive文件夹中:

查看hdfs上的jieba.csv文件前20条数据的内容后启动hive:

在数据库hive里创建文档表jieba:

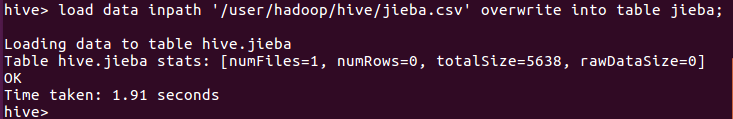

导入文件内容到表jieba:

最后查看表的总数据条数。