//2019.09.10

神经网络入门与学习

1、神经网络的发展主要得益于三个方面的进步:(1)2进制的创新能力的发展(2)软硬件能力的发展;(3)人的性价比的下降。

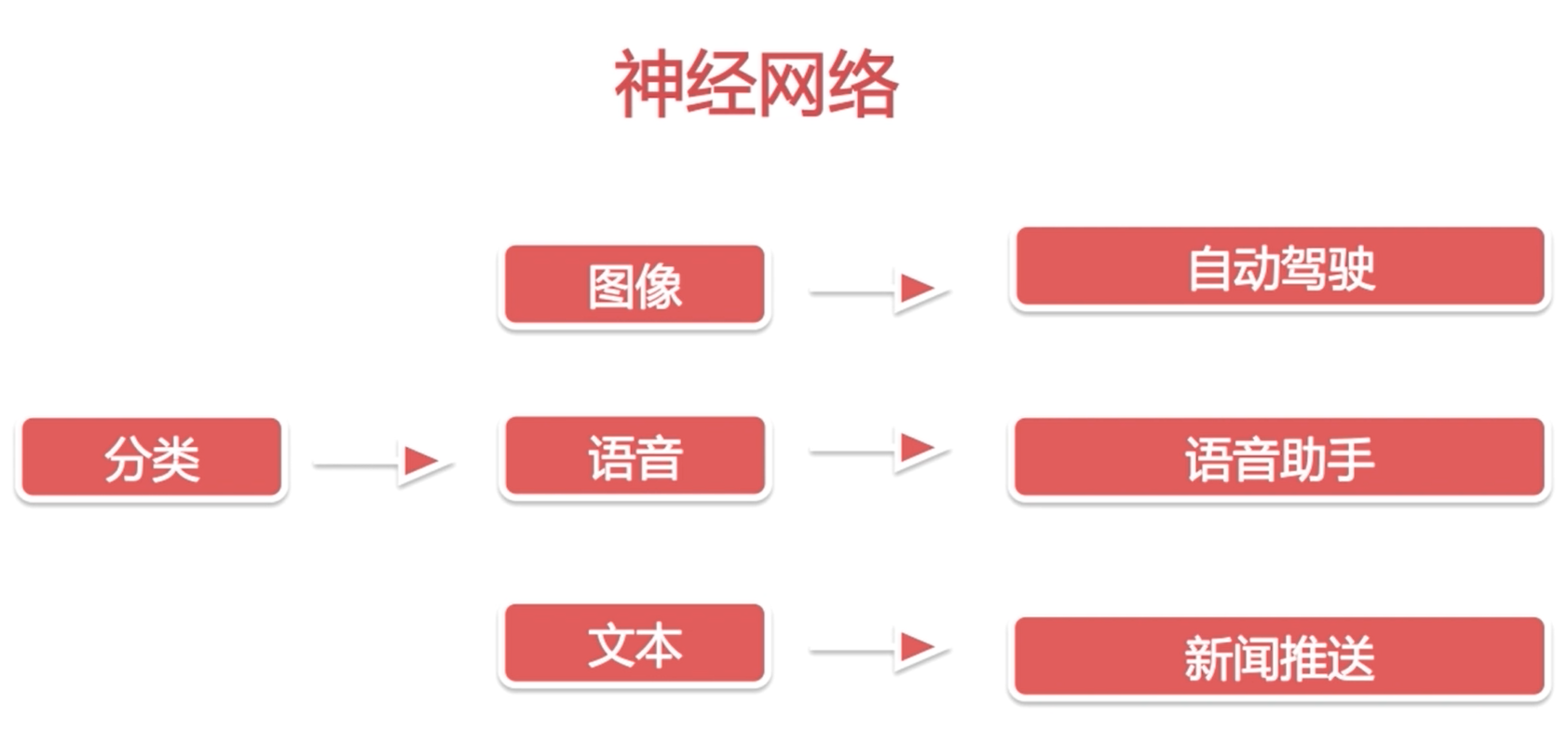

2、神经网络的成熟应用目前主要体现在分类识别上,具体来说可以分类到三个方面:

(1)图像识别:主要用于人脸识别和自动驾驶;

(2)语音识别:主要用于语音助手等;

(3)文本识别:主要用于字体识别和新闻文本推送等。

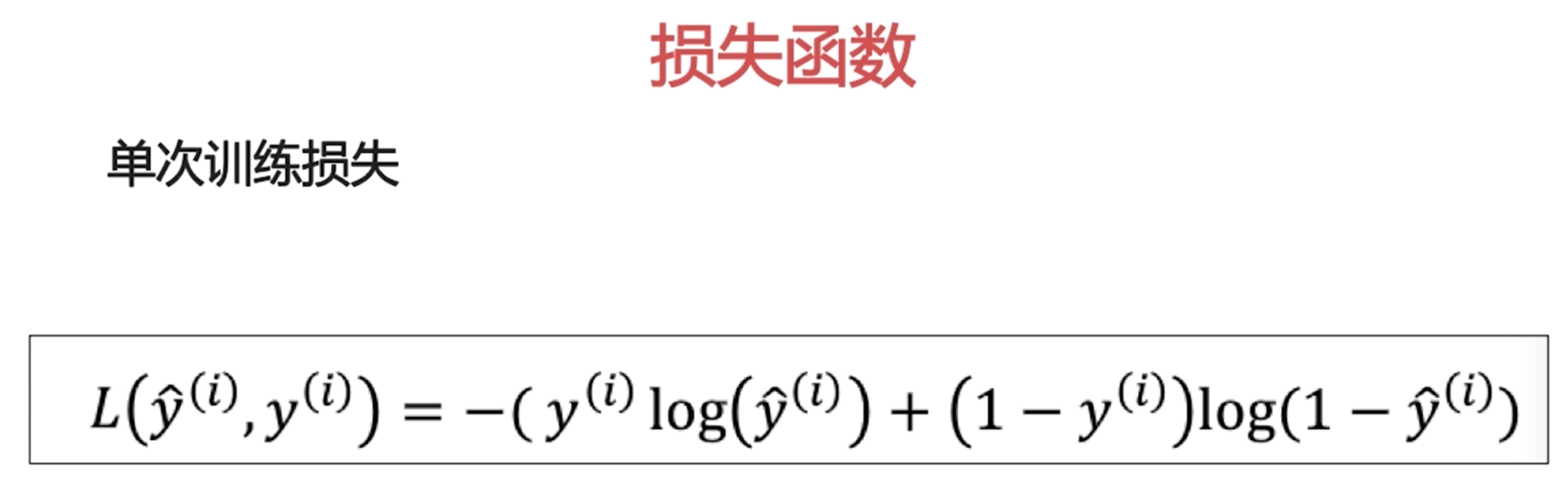

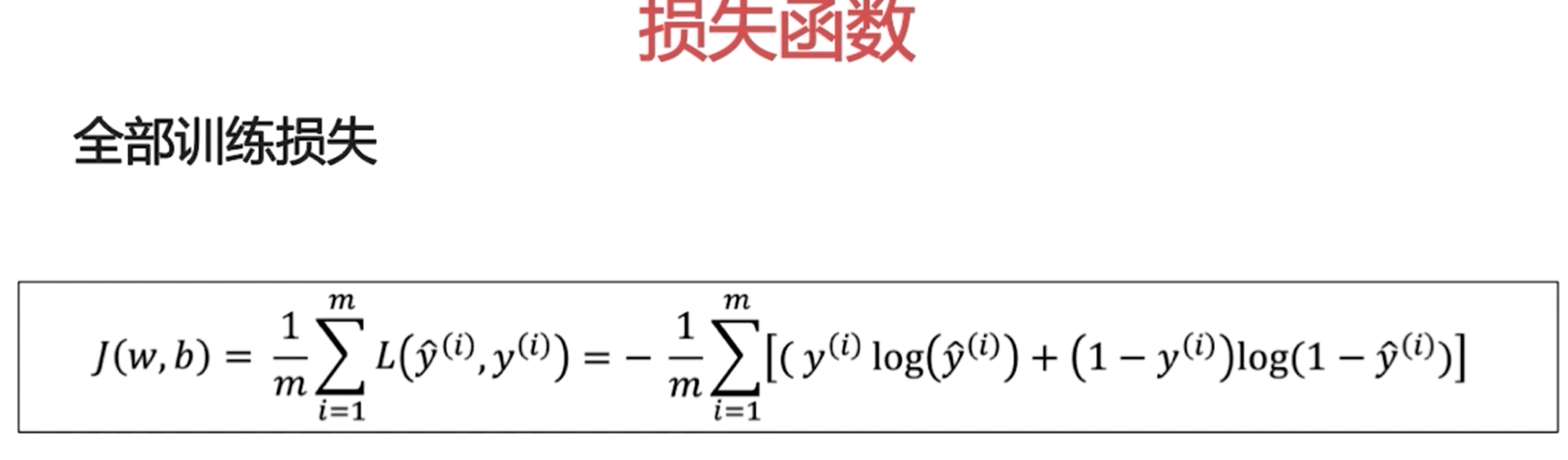

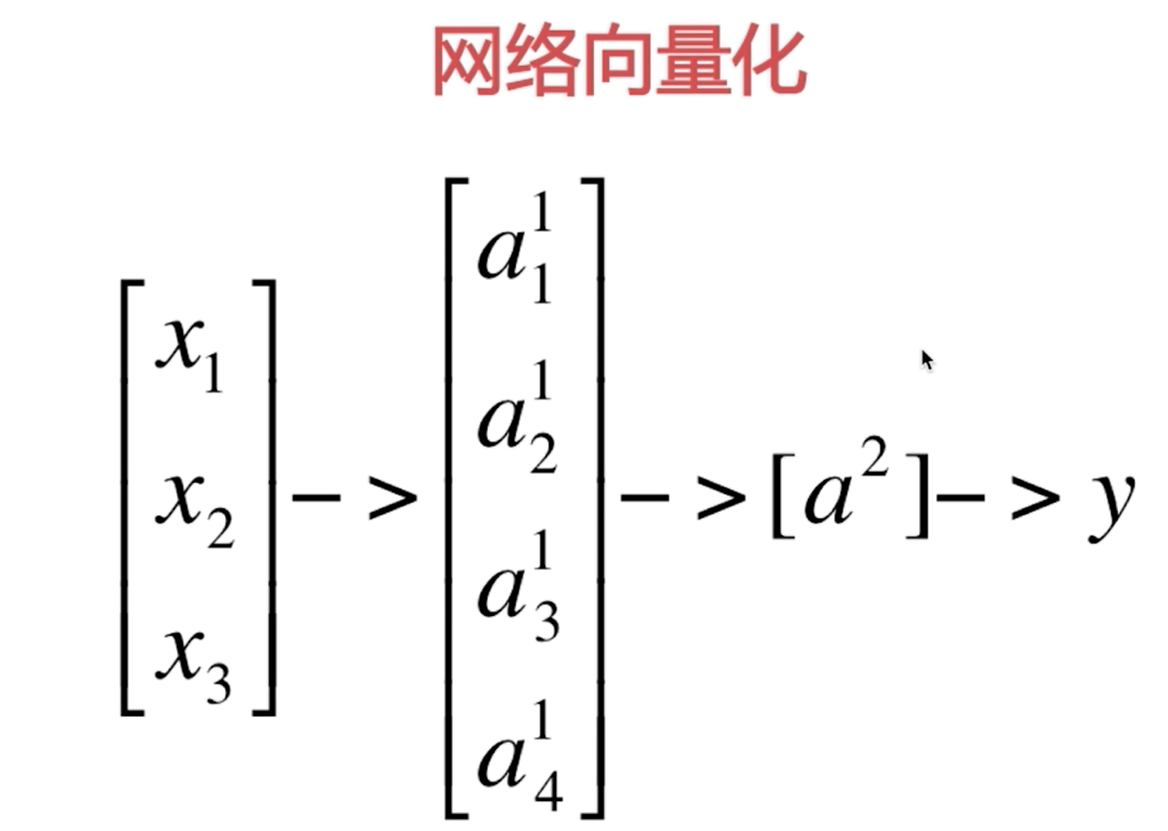

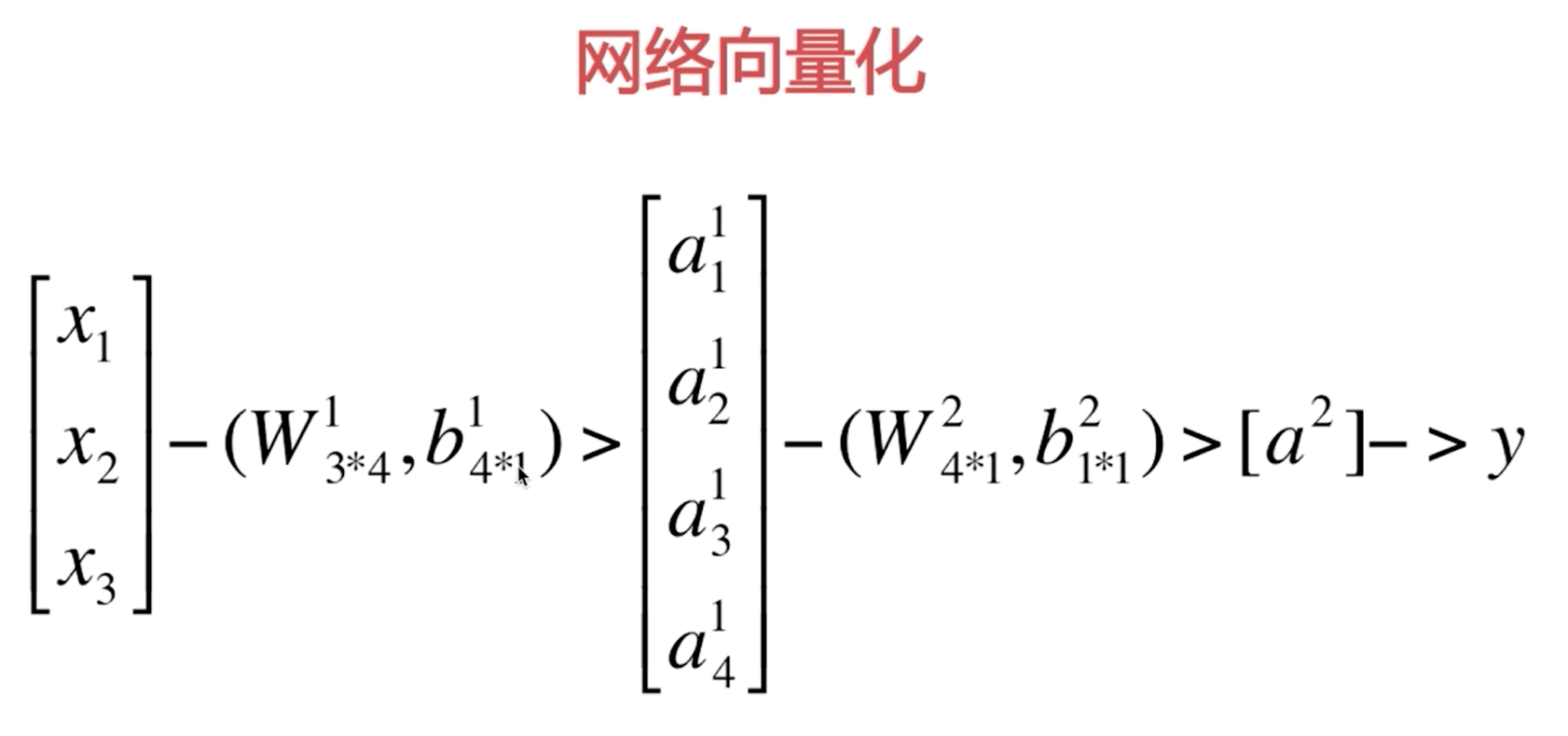

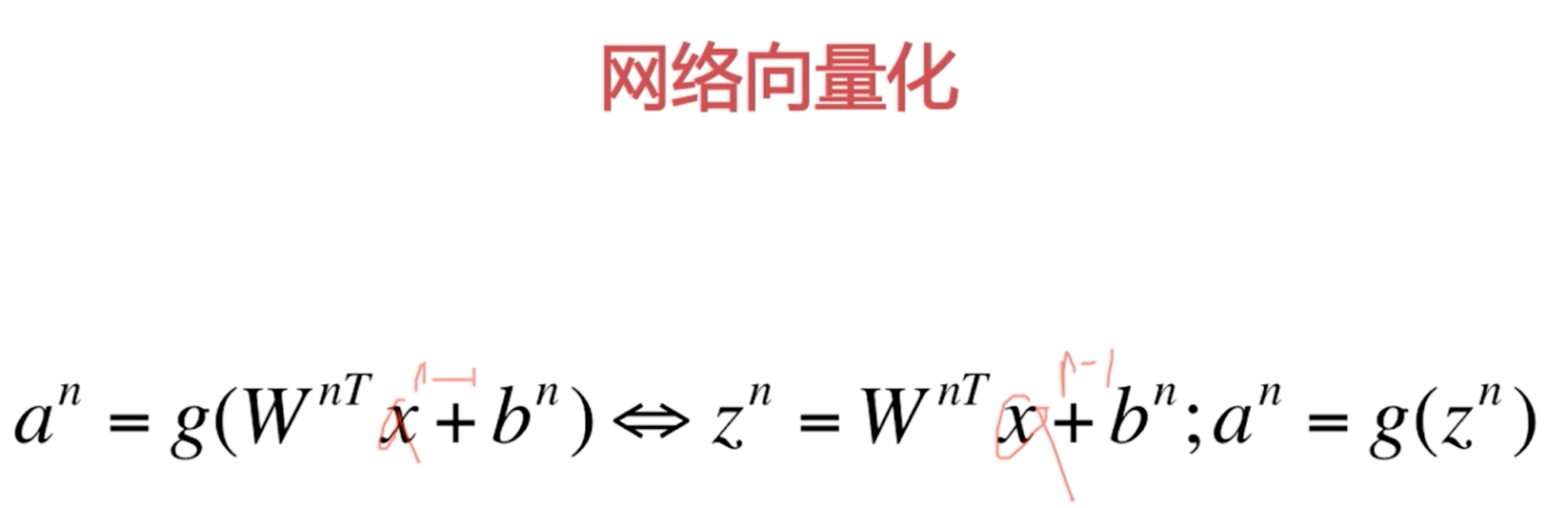

图1

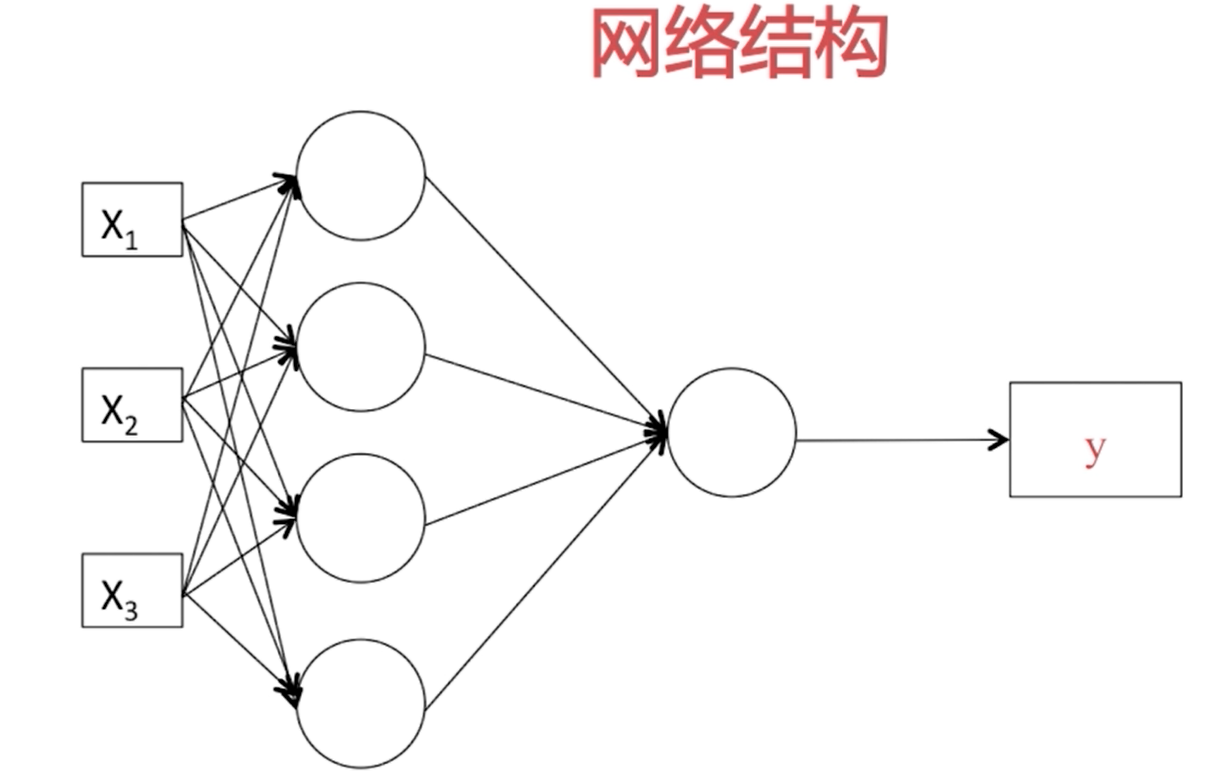

3、神经网络的结构主要包括四个方面:

(1)网络结构

(2)激励函数

(3)损失函数

(4)梯度下降

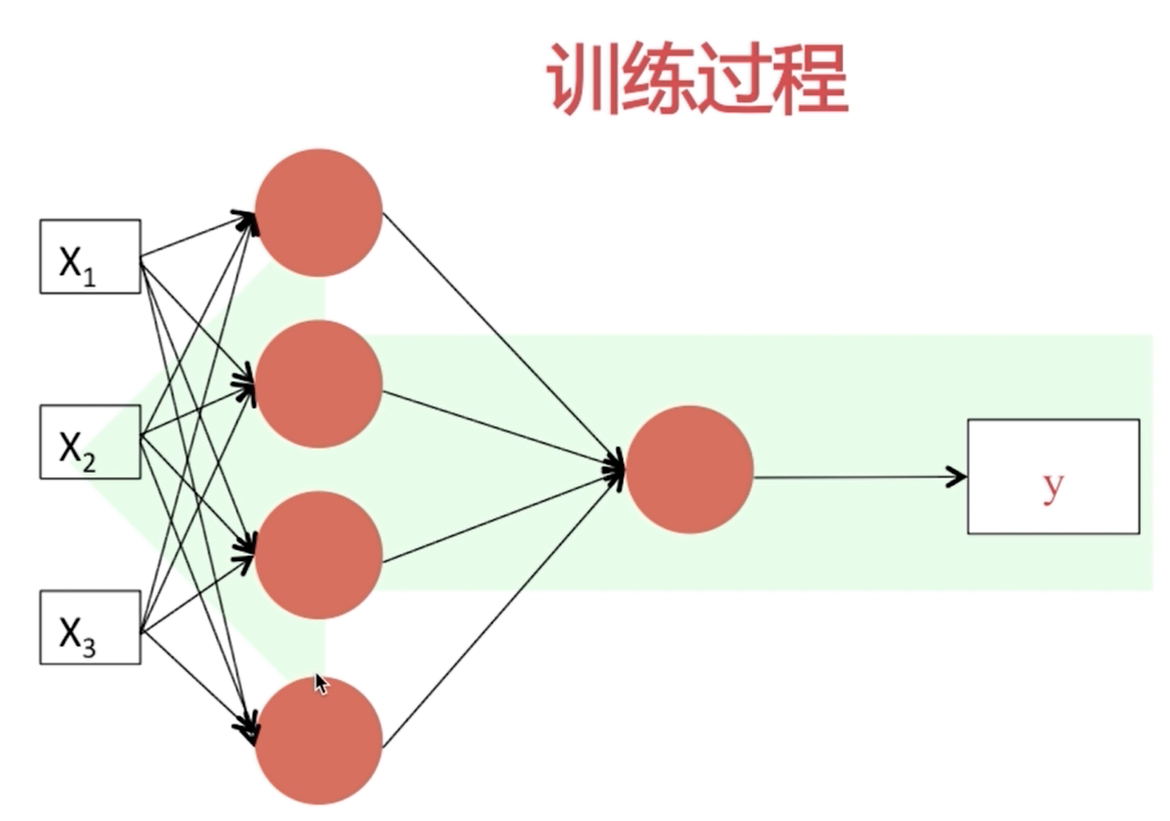

4、神经网络的网络结构主要如下所示:输入层,隐含层,输出层,并且隐含层的层数是可以设置的。最为简单的单层神经网络结构如下图所示:

图2

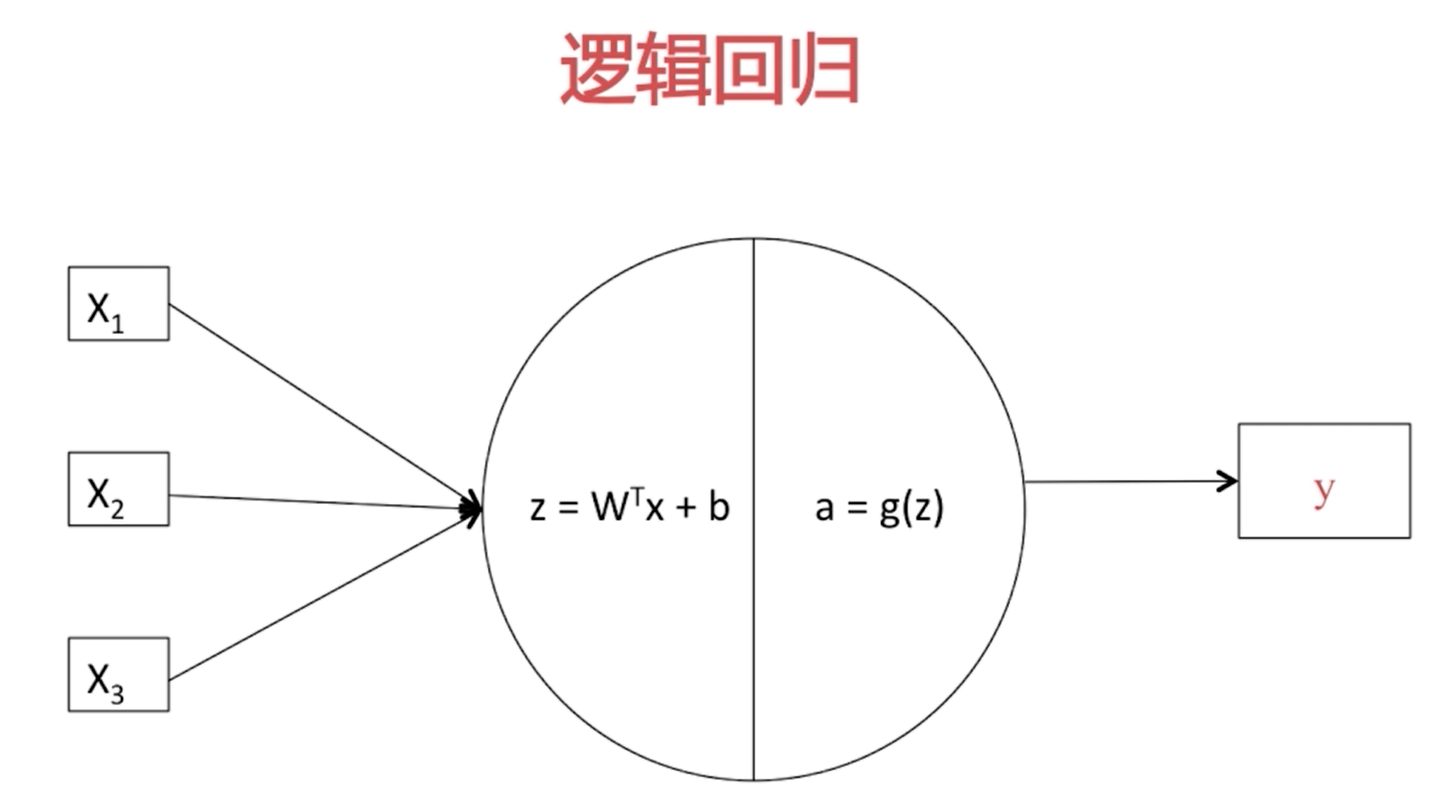

5、对于神经网络里面搭建的每一个神经元,主要包括两个先后的数据处理和转换,第一步是线性化:将前一层的所有输出数据利用线性化的方法转换为一个整体的数或者结果,第二步是将其线性化的结果经过神经网络网络结构最重要的组成——激励函数的处理,使其产生非线性的转换,然后传到下一层神经元,一层一层循环,最终输出预测结果。

图3

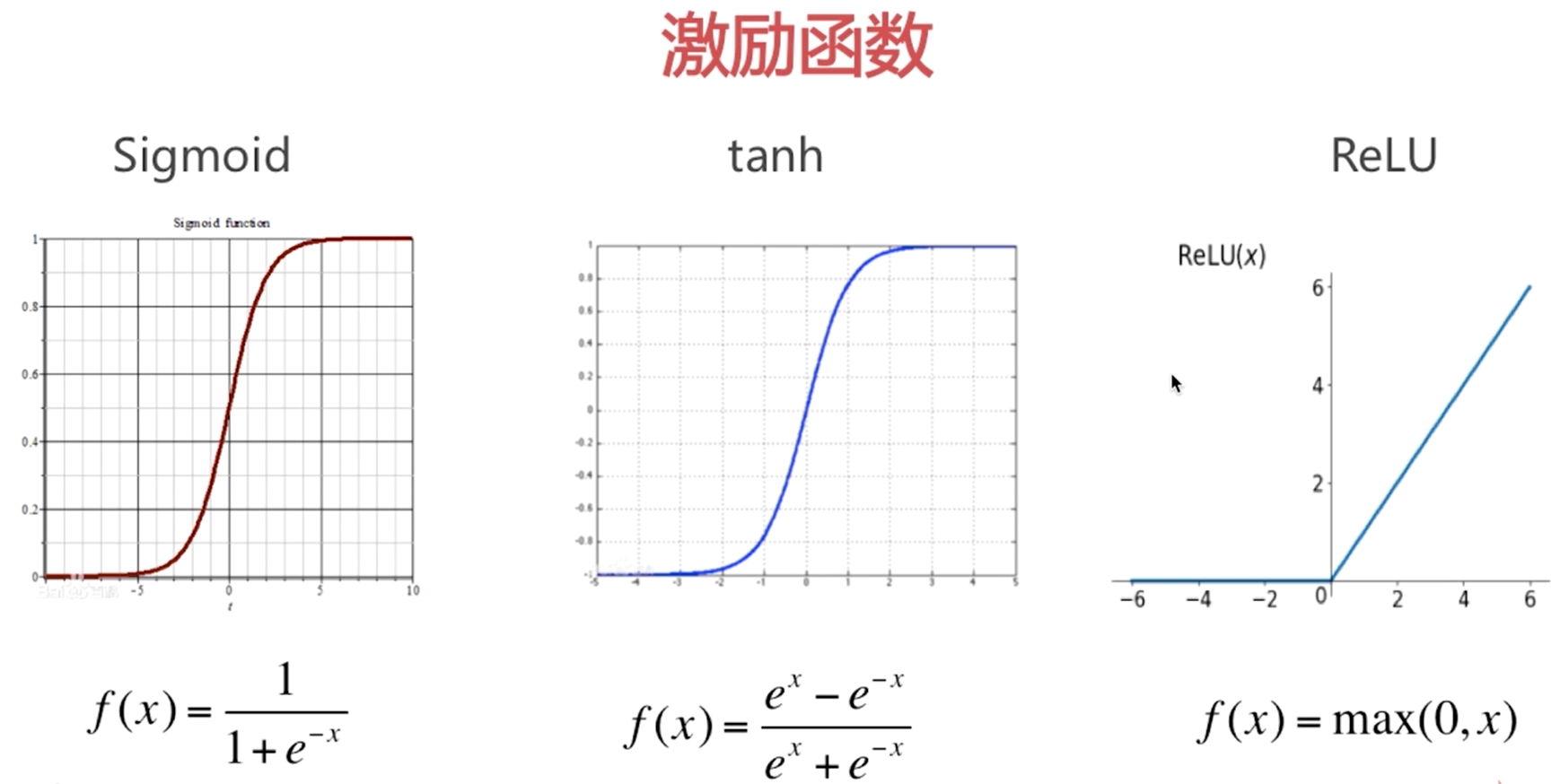

6、神经网络里面的激励函数的作用是为神经网络提供规模化的非线性能力,其主要有以下几个函数形式:

(1)sigmoid函数(处处可导)

(2)tanh函数(处处可导)

(3)ReLU函数(综合性能优良,普适性较高,目前最为常用的激励函数)

7、损失函数主要是神经网络所预测值与实际值的差值平均,其越小越好,整体的神经网络的训练目的就是使得其训练的损失函数最小,一般为了方便利用梯度下降法求取损失函数最小值,所以一般都需要采用凸函数,方便进行梯度下降法运算。另外,神经网络每一层之间的计算为了算法的一致性,一般都会统一为向量化运算的形式

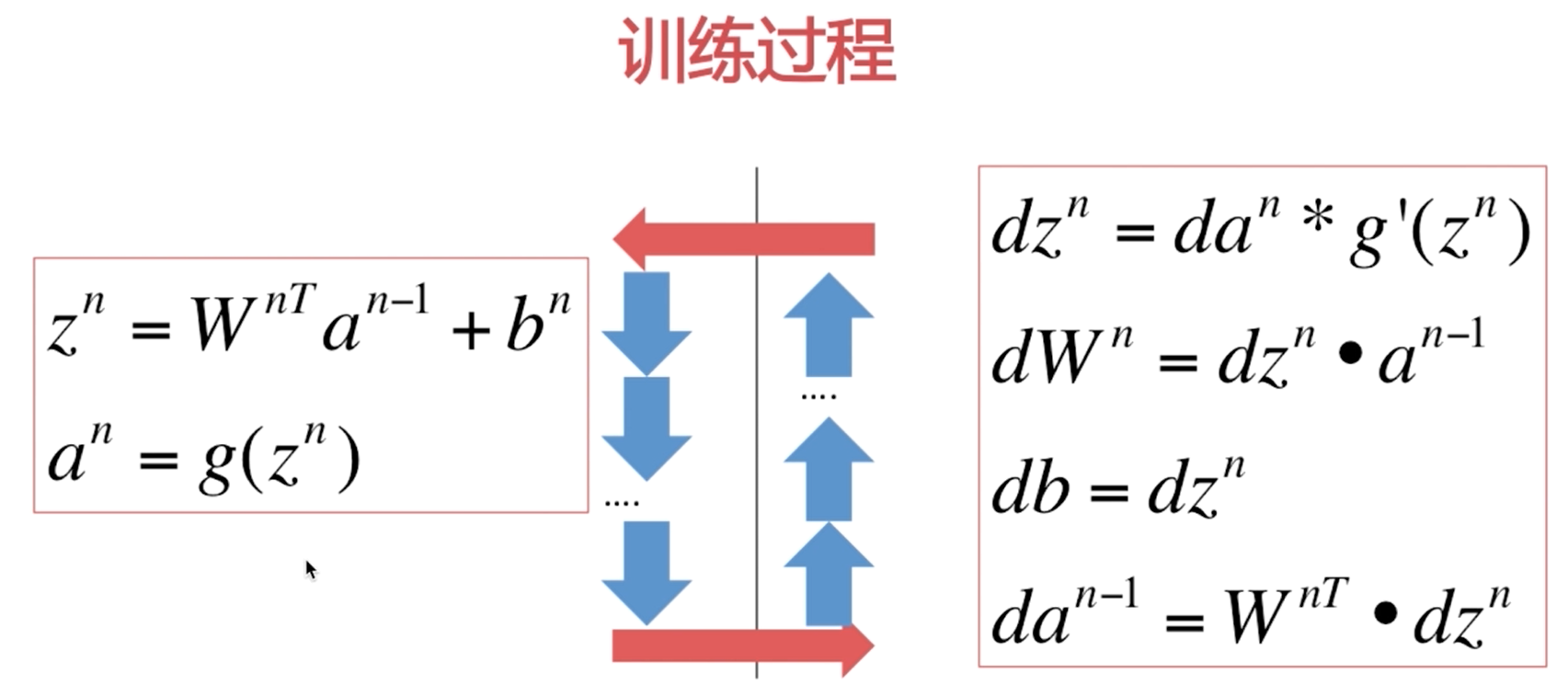

8、神经网络的训练过程主要是利用反向传播的原理来进行的网络梯度下降寻优,对于给定的初始值W,b,g(x)等,利用梯度下降法的原理来进行损失函数求最小值,然后在不断地梯度下降中同时调节每一层的参数(此为一次调节),最终找到最好的模型参数。

图

9、神经网络的基本结构和核心组件组成,对于神经网络的整体过程主要包括两个方面:数据预测训练和超参数调整,利用的方法是网络梯度下降法。