1.Hash Map的数据结构?

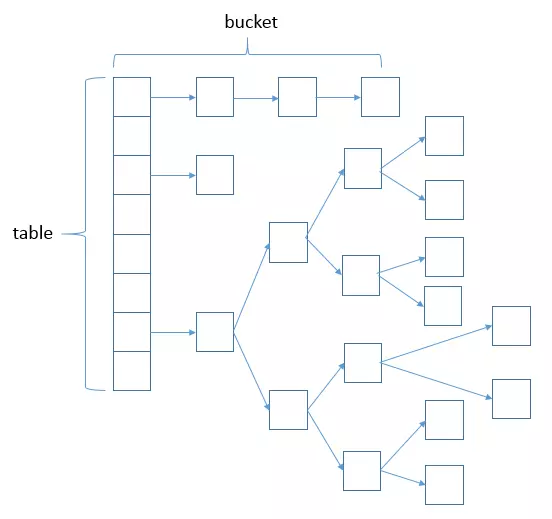

A:哈希表结构(链表散列:数组+链表)实现,结合数组和链表的优点。当链表长度超过8时,链表转换为红黑树。

transient Node<K,V>[] table;

2.HashMap的工作原理

A:HashMap底层是hash数组和单向链表实现,数组中的每个元素都是链表,由Node内部类(实现Map.Entry<k,V>接口)实现,HashMap通过put&get方法存储和获取。

存储对象时,将K/V键值对传给put()方法;

①、调用hash(K)方法计算K的hash值,然后结合数组长度,计算得数组下标;

②、调整数组大小(当容器中得元素个数大于capacity*loadFactor时,容器会进行resize为2n)

③、

i、如果K的hash值在HashMap不存在,则执行插入;若存在,则发生碰撞;

ii、如果K的hash值在HashMap存在,且它们两者equals返回true,则更新键值对;

iii、如果K的hash值在HashMap存在,且它们两者equals返回false,则插入链表的尾部(尾插法)或者红黑树(树的添加方式)

(JDK1.7 之前使用头插法、JDK 1.8 使用尾插法)

(注意:当碰撞导致链表大于TREEIFY_THRESHOLD = 8时,就把链表转换为红黑树)

获取对象时,将K传给get()方法:

①、调用hash(K)方法(计算K的hash值)从而获取该键值对所在链表的数组下标;

②、顺序遍历链表,equals()方法查找相同Node链表K值对应的V值

hashCode是定位的,存储位置;

equals是定性的,比较两者是否相等。

3.当两个对象的hashCode相同会发生什么?

A:因为hashCode相同,不一定就是相等的(equals方法比较),所以两个对象所在数组下标相同,“碰撞”就此发生。又因为HashMap使用链表存储对象,这个Node会存储到链表下。

4.:你知道hash的实现吗?为什么要这样实现?

A:JDK1.8中,是通过hashCode()的高16位异或低16位实现的:(h = k.hashCode()^(h>>>16))

主要是从速度、功效和质量来考虑的,减少系统的开销,也不会造成因为高位没有参与下标的计算,从而引起的碰撞。

5:为什么要用异或运算符?

A:保持了对象的hashCode的32位值只要有一位发生改变,整个hash()返回值就会改变。尽可能的减少碰撞。

6.HashMap的table的容量如何确定?loadFactor是什么?该容量如何变化?这种变化会带来什么问题?

A:

①、table数组大小是由capacity这个参数确定的,默认是16,也可以构造时传入,最大限制为1<<30;

②、loadFactor是负载因子,主要目的是用来确认table数组是否需要动态扩展,默认值是0.75,比如table数组大小为16,装载因子为0.75时,threshold就是12,当table的实际大小超过12时,table就需要动态扩容;

③、扩容时,调用resize()方法,将table长度变为原来的两倍(注意是table长度,而不是threshold)

④、如果数据很大的情况下,扩展时将会带来性能的损失,在性能要求很高的地方,这种损失很可能很致命。

7.HashMap的遍历方式及其性能对比

A:主要四种方式

no1、for-each map.keySet()——只需要K值得时候推荐使用

for(String key : map.keySet()) { map.get(key); }

no2、for-each map.entrySet()——当需要V值得时候推荐使用

for(Map.Entry<String, String> entry : map.entrySet()) { entry.getKey(); entry.getValue(); }

no3、for-each map.entrySet() + 临时变量

Set<Map.Entry<String, String>> entrySet = map.entrySet(); for (Map.Entry<String, String> entry : entrySet) { entry.getKey(); entry.getValue(); }

no4、for-each map.entrySet().iterator()

Iterator<Map.Entry<String,String>> iterator =

map.entrySet().iterator(); while (iterator.hasNext()) { Map.Entry<String, String> entry = iterator.next(); entry.getKey(); entry.getValue(); }

8.HashMap、LinkedHashMap、TreeMap有什么区别?

A:HashMap参考其他问题;

LinkedHashMap保存了记录得插入顺序,用iterator遍历时,先取到得记录肯定是先插入得;遍历比HashMap慢;

TreeMap实现SortMap接口,能够把它保存的记录根据键排序(默认按键值升序排序,也可以知道排序得比较器)

9.HashMap & TreeMap & LinkedHashMap 使用场景?

A:一般情况下,使用最多得是HashMao;

HashMap:在Map中插入、删除和定位元素时;

TreeMap:在需要按自然顺序或自定义顺序遍历键得情况下;

LinkedHashMap:在需要输出的顺序和输入的顺序相同的情况下。

10.HashMap和HashTable有什么区别?

A:

①、HashMap是线程不安全,HashTable是线程安全的;

②、由于线程安全,所以HashTable的效率比不上HashMap;

③、HashMap最多只允许一条记录的键为null,允许多条激励的值为null,而HashTable不允许;

④、HashMao默认初始化数组的大小为16,HashTable为11,前者扩容时,扩大两倍,后者扩大两倍+1;

⑤、HashMap需要重新计算hash值,而HashTable直接使用对象的hashCode。

11.同样是线程类,ConcurrentHashMap 和 HashTable 在线程同步上有什么不同

A:ConcurrentHashMap类(是Java并发包java.util.concurrent中提供的一个线程安全且高效的Hash Map实现)

HashTable是使用synchronize关键字加锁的原理(就是对对象加锁)

而针对ConcurrentHashMap,在JDK1.7 中采用分段锁的方式,JDK1.8 中直接采用了CAS(无锁算法)+ synchronized。

12.HashMap & ConcurrentHashMap 的区别?

A:除了加锁,原理上无太大区别。

另外,HashMap的键值对允许有null,但是ConcurrentHashMap 都不允许。

13.为什么 ConcurrentHashMap 比 HashTable 效率要高?

A:HashTable使用一把锁(锁住整个链表结构)处理并发问题,多个线程竞争一把锁,容易阻塞;

ConcurrentHashMap :

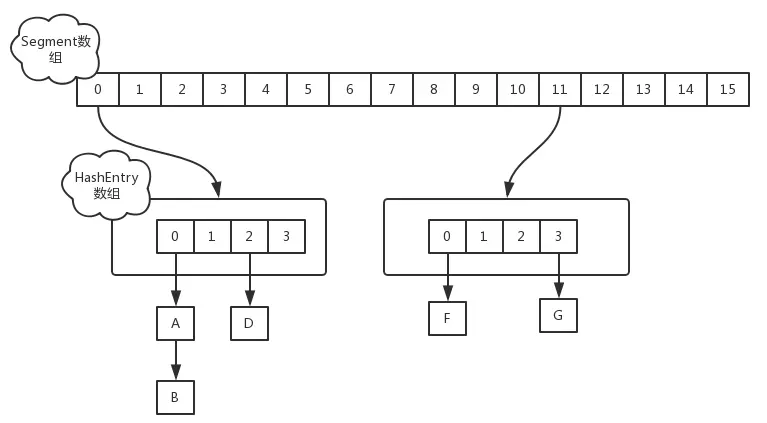

JDK1.7使用分段锁(ReentrantLock + Segment + HashEntry)相当于把一个HashMap分成多个段,每段分配一把锁,这样支持多线程访问。锁粒度:基于Segment,包含多个HashEntry。

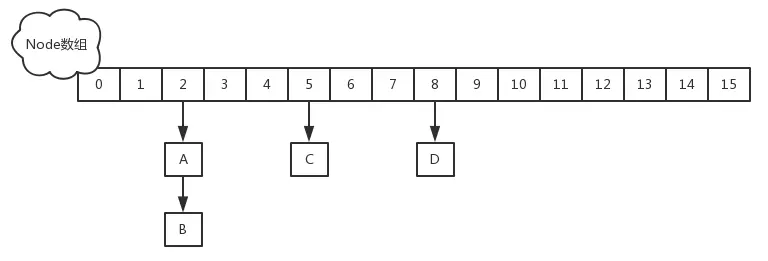

JDK1.8使用CAS + synchronized + Node + 红黑树。 锁粒度:Node(首结点)(实现Map.Entry<K,V>)。锁粒度降低了。

14:针对 ConcurrentHashMap 锁机制具体分析(JDK 1.7 VS JDK 1.8)?

A:JDK1.7中,采用分段锁的机制,实现并发的更新操作,底层采用数组+链表的存储结构,包括两个核心静态内部类Segment 和 HashEntry。

①、 Segment 继承 ReentrantLock(重入锁) 用来充当锁的角色,每个 Segment 对象守护每个散列映射表的若干个桶;

②、HashEntry用来封装映射表的键值对

③、每个桶是由若干个 HashEntry 对象链接起来的链表。

15:ConcurrentHashMap 在 JDK 1.8 中,为什么要使用内置锁 synchronized 来代替重入锁 ReentrantLock?

A:

i、粒度降低了

ii、JVM开发团队没有放弃synchronized,而且基于JVM的synchronized优化空间更大、更加自然

iii、在大量的数据操作下,对于JVM的内存压力,基于API的ReentrantLock会开销更多的内存。

①、重要的常量:

private transient volatile int sizeCtl;

当为负数时,-1 表示正在初始化,-N 表示 N - 1 个线程正在进行扩容;

当为 0 时,表示 table 还没有初始化;

当为其他正数时,表示初始化或者下一次进行扩容的大小。

②、数据结构:

Node 是存储结构的基本单元,继承 HashMap 中的 Entry,用于存储数据;

TreeNode 继承 Node,但是数据结构换成了二叉树结构,是红黑树的存储结构,用于红黑树中存储数据;

TreeBin 是封装 TreeNode 的容器,提供转换红黑树的一些条件和锁的控制。

③、存储对象时(put() 方法):

1.如果没有初始化,就调用 initTable() 方法来进行初始化;

2.如果没有 hash 冲突就直接 CAS 无锁插入;

3.如果需要扩容,就先进行扩容;

4.如果存在 hash 冲突,就加锁来保证线程安全,两种情况:一种是链表形式就直接遍历到尾端插入,一种是红黑树就按照红黑树结构插入;

5.如果该链表的数量大于阀值 8,就要先转换成红黑树的结构,break 再一次进入循环

6.如果添加成功就调用 addCount() 方法统计 size,并且检查是否需要扩容。

④、扩容方法 transfer():默认容量为 16,扩容时,容量变为原来的两倍。

helpTransfer():调用多个工作线程一起帮助进行扩容,这样的效率就会更高。

⑤、获取对象时(get()方法):

1.计算 hash 值,定位到该 table 索引位置,如果是首结点符合就返回;

2.如果遇到扩容时,会调用标记正在扩容结点 ForwardingNode.find()方法,查找该结点,匹配就返回;

3.以上都不符合的话,就往下遍历结点,匹配就返回,否则最后就返回 null。

A:程序运行时能够同时更新 ConccurentHashMap 且不产生锁竞争的最大线程数。默认为 16,且可以在构造函数中设置。当用户设置并发度时,ConcurrentHashMap 会使用大于等于该值的最小2幂指数作为实际并发度(假如用户设置并发度为17,实际并发度则为32)

作者:TinyDolphin

链接:https://www.jianshu.com/p/75adf47958a7

來源:简书

简书著作权归作者所有,任何形式的转载都请联系作者获得授权并注明出处。