1. 将新闻的正文内容保存到文本文件。

def addcontent(content): f = open("F:/study/大三/大数据/content.txt", "a") f.write(' '+content) f.close()

2. 将新闻数据结构化为字典的列表:

- 单条新闻的详情-->字典news

- 一个列表页所有单条新闻汇总-->列表newsls.append(news)

- 所有列表页的所有新闻汇总列表newstotal.extend(newsls)

def getNewDetail(newsUrl): news = {} rq = requests.get(newsUrl) rq.encoding = "utf-8" soup = BeautifulSoup(rq.text, 'html.parser') content = soup.select("#content")[0].text addcontent(content) info = soup.select(".show-info")[0].text #news["author"] = info[info.find('作者:'):].split()[0].lstrip('作者:') Auditing = info[info.find('审核:'):].split()[0].lstrip('审核:') photo = info[info.find('摄影:'):].split()[0].lstrip('摄影:') news["title"] = soup.select(".show-title")[0].text #news["source"] = info[info.find('来源:'):].split()[0].lstrip('来源:') from datetime import datetime news["datetime"] = datetime.strptime(info.lstrip('发布时间:')[0:19], "%Y-%m-%d %H:%M:%S") news["click"] = getClickCount(newsUrl) return news

def getListPage(newsurl): res = requests.get(newsurl) # 返回response对象 res.encoding = 'utf-8' soup = BeautifulSoup(res.text, 'html.parser') newList = [] for news in soup.select("li"): if (len(news.select('.news-list-info')) > 0): newsUrl = news.select('a')[0].attrs['href'] newDital = getNewDetail(newsUrl) newList.append(newDital) return newList

newsurl = 'http://news.gzcc.cn/html/xiaoyuanxinwen' newsTotal = [] newsTotal.extend(getListPage(newsurl)) n = getPageN(newsurl) for i in range(2,2): newsurl = 'http://news.gzcc.cn/html/xiaoyuanxinwen/{}.html'.format(i) newsTotal.extend(getListPage(newsurl))

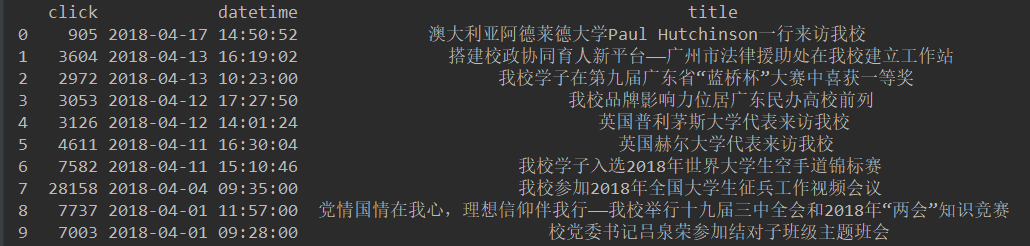

3. 安装pandas,用pandas.DataFrame(newstotal),创建一个DataFrame对象df.

df = pandas.DataFrame(newsTotal) print(df)

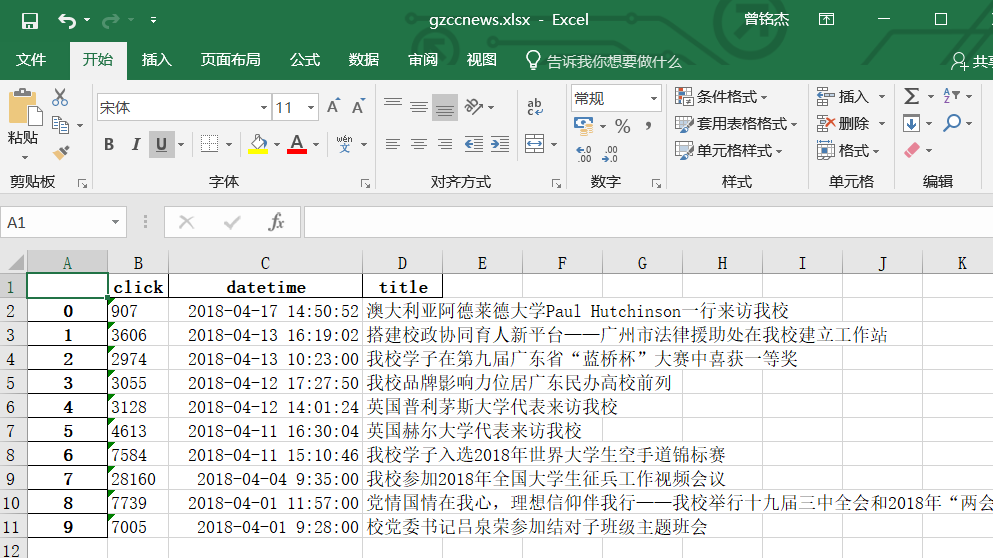

4. 通过df将提取的数据保存到csv或excel 文件。

df.to_excel("gzccnews.xlsx",encoding="utf-8")

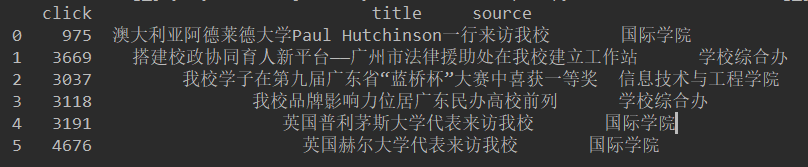

5. 用pandas提供的函数和方法进行数据分析:

- 提取包含点击次数、标题、来源的前6行数据

- 提取‘学校综合办’发布的,‘点击次数’超过3000的新闻。

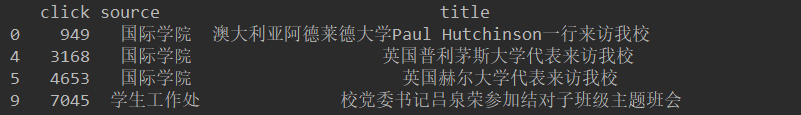

- 提取'国际学院'和'学生工作处'发布的新闻。

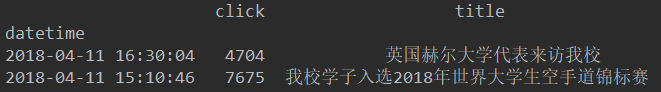

- 进取2018年3月的新闻

print(df[['click','title','source']].head(6))

print(df[(df['click']>3000)&(df['source']=='学校综合办')])

print(df[(df['source']=='国际学院')|(df['source']=='学生工作处')])

由于前10条新闻没有3月的,这里直接查询2018-04-11的新闻

print(df1['2018-04-11'])

6. 保存到sqlite3数据库

7. 从sqlite3读数据

import sqlite3 with sqlite3.connect("gzccdb.sqlite") as db: df1.to_sql('gzccdb01',con=db,if_exists='replace') with sqlite3.connect("gzccdb.sqlite") as db: df2 = pandas.read_sql_query("select *from gzccdb01",con=db) print("df2: ",df2)

8. df保存到mysql数据库

安装SQLALchemy

安装PyMySQL

MySQL里创建数据库:create database gzccnews charset utf8;

import pymysql

from sqlalchemy import create_engine

conn = create_engine('mysql+pymysql://root:root@localhost:3306/gzccnews?charset=utf8')

pandas.io.sql.to_sql(df, 'gzccnews', con=conn, if_exists='replace')

MySQL里查看已保存了数据。(通过MySQL Client或Navicate。)

import pymysql from sqlalchemy import create_engine coon = create_engine('mysql+pymysql://root:root@localhost:3306/gzccnews?charset=utf8') pandas.io.sql.to_sql(df3,"gzccnews",con=coon,if_exists='replace')