字符编码

参考链接:https://www.liaoxuefeng.com/wiki/1016959663602400/1017075323632896

字节

一个字节(byte)=8个比特(bit)

字符

ASCII 编码

由于计算机是美国人发明的,所以最早只有127个字符被编码到计算机中,也就是大小写英文字符、数字和一些符号,这个编码表被称为ASCII编码

GB2312

字符串虽然也是一种数据类型,但是他有一个比较特殊的编码问题。

因为计算机只能处理数字,如果要处理文本,就必须把文本转为数字,对应中文,就是为每个汉字确定一个编号,这个编号就代表这个汉字。

最早的计算机在设计时采用8个比特(bit)作为一个字节(byte),所以一个字节能表示的最大整数就是255,如果要表示更大的整数,就必须用更多的字节。比如两个字节可以表示的最大整数是65535,4个字节可以表示的最大整数是4294967295。

而光是常用汉字就有3500个,所以要处理中文使用一个字节是不够的,至少需要两个字节,而且还不能和ASCII冲突,所以中国就制定了GB2312编码,用来把中文编进去。

Unicode

你可以想得到的是,全世界有上百种语言,日本把日文编到Shift_JIS里,韩国把韩文编到Euc-kr里,各国有各国的标准,就会不可避免地出现冲突,结果就是,在多语言混合的文本中,显示出来会有乱码。

因此,Unicode应运而生。Unicode把所有语言都统一到一套编码里,这样就不会再有乱码问题了。

Unicode标准也在不断的发展,但最常用的是用两个字节表示一个字符(如果是非常偏僻的字符,就需要用到四个字节),现代操作系统和大多数编程语言都直接支持Unicode

支持Unicode编码就意味着支持多语言

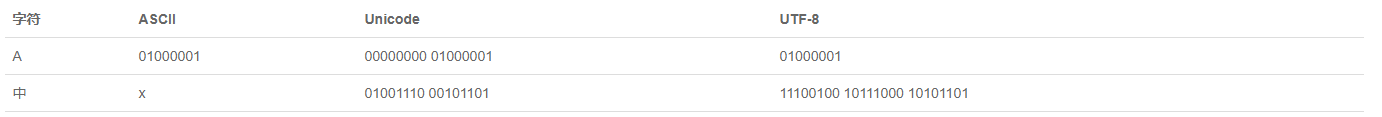

现在,捋一捋ASCII编码和Unicode编码的区别:

ASCII编码是1个字节,而Unicode编码通常是2个字节。

字母A用ASCII编码是十进制的65,二进制的01000001;

字符0用ASCII编码是十进制的48,二进制的00110000,注意字符'0'和整数0是不同的;

汉字中已经超出了ASCII编码的范围,用Unicode编码是十进制的20013,二进制的01001110 00101101。

你可以猜测,如果把ASCII编码的A用Unicode编码,只需要在前面补0就可以,因此,A的Unicode编码是00000000 01000001。

Utf-8

采用Unicode编码会带来一个新的问题,由于原本一个英文字符只需要一个字节,但使用Unicode编码需要两个字节,在传输和储存上就变得十分不划算。

所以本着节约的精神,就又把Unicode编码转变为可变长度的Utf-8编码

UTF-8编码把一个Unicode字符根据不同的数字大小编码成1-6个字节,常用的英文字母被编码成1个字节,汉字通常是3个字节,只有很生僻的字符才会被编码成4-6个字节。如果你要传输的文本包含大量英文字符,用UTF-8编码就能节省空间:

UTF-8编码有一个额外的好处,就是ASCII编码实际上可以被看成是UTF-8编码的一部分,所以,大量只支持ASCII编码的历史遗留软件可以在UTF-8编码下继续工作。

作者说清楚了ASCII、Unicode、Utf-8他们之间的关系,然后就告诉我们说可以现在可以总结计算机系统通用的字符编码方式:

在计算机内存中,统一使用Unicode编码,当需要保存到硬盘或者进行传输的时候,就转话为Utf-8编码

然后作者又举了一些常用的例子

python字符串

Unicode编码就是意味着支持多语言,Python3的字符串采用的Unicode编码

然后作者介绍了一些函数

ord( )函数

可以获取单个字符的的整数表示,注意一是单个,二是字符

char( )函数

把编码转换为相应的字符

>>> help(chr)

Help on built-in function chr in module builtins:

chr(i, /)

Return a Unicode string of one character with ordinal i; 0 <= i <= 0x10ffff.

>>>chr(97)

>>>'a'

如果知道字符的整数编码,还可以用十六进制这么写str:

>>> 'u4e2du6587' '中文'

两种写法完全是等价的。

b前缀

由于Python的字符串类型是str,在内存中以Unicode表示,一个字符对应若干个字节。如果要在网络上传输,或者保存到磁盘上,就需要把str变为以字节为单位的bytes。

Python对bytes类型(注意是一种数据类型)的数据用b前缀的单引号或者双引号表示

>>> x=b'ABC' >>> x b'ABC' >>> x=b'中文'#对于中文,用别的方法 File "<stdin>", line 1 SyntaxError: bytes can only contain ASCII literal characters. >>>

要注意区分'ABC'和b'ABC',前者是str,后者虽然内容显示得和前者一样,但bytes的每个字符都只占用一个字节。

encode( )

以Unicode表示的str通过encode( )方法可以编码为指定的bytes

>>> 'ABC'.encode('ascii')

b'ABC'

>>> '中文'.encode('utf-8')

b'xe4xb8xadxe6x96x87'

>>> '中文'.encode('ascii')

Traceback (most recent call last):

File "<stdin>", line 1, in <module>

UnicodeEncodeError: 'ascii' codec can't encode characters in position 0-1: ordinal not in range(128)

纯英文的str可以用ASCII编码为bytes,内容是一样的,含有中文的str可以用UTF-8编码为bytes。含有中文的str无法用ASCII编码,因为中文编码的范围超过了ASCII编码的范围,Python会报错。

在bytes中,无法显示为ASCII字符的字节,用x##显示

decode( )

如果我们从网络或者磁盘撒谎给你读取了字节流,那么读取到的数据就是bytes,要把bytes变为str就需要用到decode( )

>>> b'ABC'.decode('ascii')

'ABC'

>>> b'xe4xb8xadxe6x96x87'.decode('utf-8')

'中文'

如果bytes中包含无法解码的字节,decode()方法会报错:

>>> b'xe4xb8xadxff'.decode('utf-8')

Traceback (most recent call last):

...

UnicodeDecodeError: 'utf-8' codec can't decode byte 0xff in position 3: invalid start byte

如果bytes中只有一小部分无效的字节,可以传入errors='ignore'忽略错误的字节:

>>> b'xe4xb8xadxff'.decode('utf-8', errors='ignore')

'中'

len( )

要计算str包含多少个字符,可以用len()函数:

>>> len('ABC')

3

>>> len('中文')

2

len()函数计算的是str的字符数,如果换成bytes,len()函数就计算字节数:

>>> len(b'ABC')

3

>>> len(b'xe4xb8xadxe6x96x87')

6

>>> len('中文'.encode('utf-8'))

6

可见,1个中文字符经过UTF-8编码后通常会占用3个字节,而1个英文字符只占用1个字节。

在操作字符串时,我们经常遇到str和bytes的互相转换。为了避免乱码问题,应当始终坚持使用UTF-8编码对str和bytes进行转换。

由于Python源代码也是一个文本文件,所以,当你的源代码中包含中文的时候,在保存源代码时,就需要务必指定保存为UTF-8编码。当Python解释器读取源代码时,为了让它按UTF-8编码读取,我们通常在文件开头写上这两行:

#!/usr/bin/env python3#告诉Linux/OS X系统,这是一个Python可执行程序,Windows系统会忽略这个注释; # -*- coding: utf-8 -*-#告诉Python解释器,按照UTF-8编码读取源代码,否则,你在源代码中写的中文输出可能会有乱码。

申明了UTF-8编码并不意味着你的.py文件就是UTF-8编码的,必须并且要确保文本编辑器正在使用UTF-8 without BOM编码:

作为编码问题集合:

*)UnicodeDecodeError: 'utf-8' codec can't decode byte 0xc8 in position 2: invalid continuation byte

print(output.decode('utf-8'))#这是由于windows 运行环境默认的字符编码是gbk,而unix底层的运行环境是utf-8,如果在windows运行环境下报错的话,改下解码字符集就好了

#改为

print(output.decode('gbk'))

这是因为

2)UnicodeDecodeError: 'utf-8' codec can't decode byte 0xbd in position 0: invalid start byte

从晚上复制的文本以ANSI编码储存为新文件使用以下代码报错

import numpy as np

DATA_PATH = r'C:UsersAdministrator.SC-201605202132AppDataLocalProgramsPythonPython37forTest est.txt'

SENTENSE_NUM = 200000 #要读取的句子数目

X = []

y = []

with open(DATA_PATH,'rt',encoding='utf8') as f:#

for s in f.readlines():#这里报错

s = s.strip()

if not s:

continue

tag_index = []

for i in range(0,len(s)-1):

c = s[i]

if c == '|':

continue

next_c = s[i+1]

if next_c == '|':

tag_index.append(1)

else:

tag_index.append(0)

s = s.replace('|','')

X.append(list(s))

y.append(tag_index)

if len(X)>SENTENSE_NUM:

break

X = np.array(X)

y = np.array(y)

print('X[0]:',X[0])

print('y[0]:',y[0])

解决办法,通过将源文件另存为的工程中选择编码方式为“utf-8”来解决

1)UnicodeDecodeError: 'gbk' codec can't...

去年在写一个批量读取文件夹下的指定文件类型的所有文件中遇到了一个小错误,今天终于把他干掉了,小小的成就感,记录一下

错误:

1 Traceback (most recent call last): 2 File "<pyshell#84>", line 1, in <module> 3 open(path, encoding='gbk', mode='r').read() 4 UnicodeDecodeError: 'gbk' codec can't decode byte 0x88 in position 38: illegal multibyte sequence

解决办法:

#! python3

# chapter08-test03.py - 打开文件夹中所有的.txt文件

# 结果打印在屏幕上

import os,re

import chardet

#定义获取文件编码的函数

def get_encoding(file):

with open(file,'rb') as f:

return chardet.detect(f.read())['encoding']

path=os.path.join('F:便签')

fileNameList=os.listdir(path) #listdir()返回一个包含路径path下所有文件名称的列表

for objFile in fileNameList:

fileType=os.path.splitext(os.path.join(path,objFile))

#splitext()会返回路径名和扩展名的元组

if fileType[1]=='.txt':

correctFileName=os.path.join(path,objFile)#拼接出来文件的完整地址

encoding=get_encoding(correctFileName)

#这里是关键点

searchObjFile=open(correctFileName,encoding=encoding,errors='ignore')

print('*'*20+str(correctFileName)+'*'*20) #重复打印的快捷方式是这样的

print(searchObjFile.read())

searchObjFile.close()

详细过程:

首先错误是有python3的默认编码与要打开文件的编码不同导致的

我搜到的第一个解决办法是将默认编码改成‘gbk’

searchObjFile=open(correctFileName,encoding=‘gbk’,errors='ignore')

结果无效

第二次解决办法的思想是获取每个文件的编码类型,用相应的编码去创建文件对象,这样动态的调用 open() ,这样做需要

1)获取文件编码

#定义获取文件编码的函数

def get_encoding(file):

with open(file,'rb') as f:

return chardet.detect(f.read())['encoding']

open() 中的‘rb’代表用二进制打开一个文件用于只读, chardet.detect(data) 用于检测data的编码类型,至于后面的 ['encoding'] 我也不知道

2)然后就是在每次调用 open() 之前获取文件编码,然后调用时传入即:

searchObjFile=open(correctFileName,encoding=encoding,errors='ignore')

可以通过设置 errors 来控制出现错误时的策略

默认的参数就是strict,代表遇到非法字符时抛出异常; 如果设置为ignore,则会忽略非法字符; 如果设置为replace,则会用?取代非法字符; 如果设置为xmlcharrefreplace,则使用XML的字符引用

这个方法有效 感谢作者!>>>原文链接