1.逻辑回归是怎么防止过拟合的?为什么正则化可以防止过拟合?(大家用自己的话介绍下)

利用正则化来防止过拟合。正则化可以有更小的权值w,从某种意义上说,表示网络的复杂度更低,对数据的拟合刚刚好

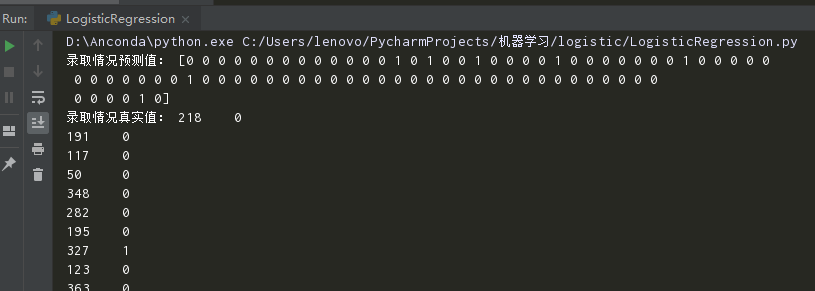

2.用logiftic回归来进行实践操作,数据不限。

1 from sklearn.linear_model import LogisticRegression #回归API 2 from sklearn.model_selection import train_test_split 3 from sklearn.metrics import classification_report 4 import pandas as pd 5 6 data = pd.read_csv('./data/LogisticRegression.csv') #(1)加载数据集 7 x_data = data.iloc[:,1:] #所有行,1到3列 8 y_data = data.iloc[:,0] #所有行,下标为0列 9 x_train,x_test,y_train,y_test = train_test_split(x_data,y_data,test_size=0.2,random_state=5)#(2)划分训练集和测试集 10 11 model_LR = LogisticRegression() #(3)构建模型并训练模型 12 model_LR.fit(x_train,y_train) 13 14 y_pre = model_LR.predict(x_test) #(4)进行模型预测 15 print("录取情况预测值:",y_pre) 16 print("录取情况真实值:",y_test) 17 print('分类报告: ', classification_report(y_test,y_pre))