公司前一段对业务线上的nginx做了整理,重点就是对nginx上负载均衡器的后端节点做健康检查。目前,nginx对后端节点健康检查的方式主要有3种,这里列出:

- ngx_http_proxy_module 模块和ngx_http_upstream_module模块(自带)官网地址:http://nginx.org/en/docs/http/ngx_http_proxy_module.html#proxy_next_upstream

- nginx_upstream_check_module模块 官网网址:https://github.com/yaoweibin/nginx_upstream_check_module

- ngx_http_healthcheck_module模块(付费) 官网网址:http://wiki.nginx.org/NginxHttpHealthcheckModule

我会分别介绍这三种实现方式以及之间的差异性。

一、ngx_http_proxy_module 模块和ngx_http_upstream_module模块(自带)

严格来说,nginx自带是没有针对负载均衡后端节点的健康检查的,但是可以通过默认自带的ngx_http_proxy_module 模块和ngx_http_upstream_module模块中的相关指令来完成当后端节点出现故障时,自动切换到健康节点来提供访问。

这里列出这两个模块中相关的指令:

ngx_http_proxy_module 模块中的 proxy_connect_timeout 指令、proxy_read_timeout指令和proxy_next_upstream指令

proxy_connect_timeout:

语法: proxy_connect_timeout time;

默认值: proxy_connect_timeout 60s;

上下文: http, server, location

设置与后端服务器建立连接的超时时间。应该注意这个超时一般不可能大于75秒。

proxy_read_timeout:

语法: proxy_read_timeout time;

默认值: proxy_read_timeout 60s;

上下文: http, server, location

定义从后端服务器读取响应的超时。此超时是指相邻两次读操作之间的最长时间间隔,而不是整个响应传输完成的最长时间。如果后端服务器在超时时间段内没有传输任何数据,连接将被关闭。

proxy_next_upstream:

语法: proxy_next_upstream error | timeout | invalid_header | http_500 | http_502 | http_503 | http_504 |http_404 | off ...;

默认值: proxy_next_upstream error timeout;

上下文: http, server, location

指定在何种情况下一个失败的请求应该被发送到下一台后端服务器:

error # 和后端服务器建立连接时,或者向后端服务器发送请求时,或者从后端服务器接收响应头时,出现错误

timeout # 和后端服务器建立连接时,或者向后端服务器发送请求时,或者从后端服务器接收响应头时,出现超时

invalid_header # 后端服务器返回空响应或者非法响应头

http_500 # 后端服务器返回的响应状态码为500

http_502 # 后端服务器返回的响应状态码为502

http_503 # 后端服务器返回的响应状态码为503

http_504 # 后端服务器返回的响应状态码为504

http_404 # 后端服务器返回的响应状态码为404

off # 停止将请求发送给下一台后端服务器

需要理解一点的是,只有在没有向客户端发送任何数据以前,将请求转给下一台后端服务器才是可行的。也就是说,如果在传输响应到客户端时出现错误或者超时,这类错误是不可能恢复的。

upstream里参数讲解:

max_fails=number

# 设定Nginx与服务器通信的尝试失败的次数。在fail_timeout参数定义的时间段内,如果失败的次数达到此值,Nginx就认为服务器不可用。在下一个fail_timeout时间段,服务器不会再被尝试。 失败的尝试次数默认是1。设为0就会停止统计尝试次数,认为服务器是一直可用的。 你可以通过指令proxy_next_upstream、fastcgi_next_upstream和 memcached_next_upstream来配置什么是失败的尝试。 默认配置时,http_404状态不被认为是失败的尝试。

fail_timeout=time

# 设定服务器被认为不可用的时间段以及统计失败尝试次数的时间段。在这段时间中,服务器失败次数达到指定的尝试次数,服务器就被认为不可用。默认情况下,该超时时间是10秒。

在实际应用当中,如果你后端应用是能够快速重启的应用,比如nginx的话,自带的模块是可以满足需求的。但是需要注意。如果后端有不健康节点,负载均衡器依然会先把该请求转发给该不健康节点,然后再转发给别的节点,这样就会浪费一次转发。

可是,如果当后端应用重启时,重启操作需要很久才能完成的时候就会有可能拖死整个负载均衡器。此时,由于无法准确判断节点健康状态,导致请求handle住,出现假死状态,最终整个负载均衡器上的所有节点都无法正常响应请求。由于公司的业务程序都是java开发的,因此后端主要是nginx集群和tomcat集群。由于tomcat重启应部署上面的业务不同,有些业务启动初始化时间过长,就会导致上述现象的发生,因此不是很建议使用该模式。

并且ngx_http_upstream_module模块中的server指令中的max_fails参数设置值,也会和ngx_http_proxy_module 模块中的的proxy_next_upstream指令设置起冲突。比如如果将max_fails设置为0,则代表不对后端服务器进行健康检查,这样还会使fail_timeout参数失效(即不起作用)。此时,其实我们可以通过调节ngx_http_proxy_module 模块中的 proxy_connect_timeout 指令、proxy_read_timeout指令,通过将他们的值调低来发现不健康节点,进而将请求往健康节点转移。

以上就是nginx自带的两个和后端健康检查相关的模块。

测试:

配置文件:

upstream cluster_proxy {

# simple round-robin

server 172.16.204.130:8000 max_fails=2 fail_timeout=20s;

server 172.16.204.130:8001 max_fails=2 fail_timeout=20s;

}

server {

listen 80;

server_name nginx.proxy.com;

access_log logs/nginx_proxy_access_log main;

location / {

proxy_pass http://cluster_proxy;

proxy_next_upstream error timeout invalid_header http_500 http_502 http_503 http_504;

}

}

客户端curl测试:正常轮训

172.16.204.1 - - [29/Nov/2017:12:40:04 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000

172.16.204.1 - - [29/Nov/2017:12:40:05 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8001

172.16.204.1 - - [29/Nov/2017:12:40:06 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000

172.16.204.1 - - [29/Nov/2017:12:40:07 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8001挂掉一台机器后(每fail_timeout检测一次,检测到max_fails次失败后,请求在fail_timeout时间内不会给这个机器):

172.16.204.1 - - [29/Nov/2017:12:44:41 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8001, 172.16.204.130:8000

172.16.204.1 - - [29/Nov/2017:12:44:42 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000

172.16.204.1 - - [29/Nov/2017:12:44:43 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8001, 172.16.204.130:8000

172.16.204.1 - - [29/Nov/2017:12:44:44 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000

172.16.204.1 - - [29/Nov/2017:12:44:45 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000

172.16.204.1 - - [29/Nov/2017:12:44:46 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000

恢复服务:正常轮训

172.16.204.1 - - [29/Nov/2017:12:46:23 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000 172.16.204.1 - - [29/Nov/2017:12:46:24 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8001 172.16.204.1 - - [29/Nov/2017:12:46:25 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000 172.16.204.1 - - [29/Nov/2017:12:46:26 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8001

二、nginx_upstream_check_module模块

除了自带的上述模块,还有一个更专业的模块,来专门提供负载均衡器内节点的健康检查的。这个就是淘宝技术团队开发的 nginx 模块 nginx_upstream_check_module,通过它可以用来检测后端 realserver 的健康状态。如果后端 realserver 不可用,则所以的请求就不会转发到该节点上。

在淘宝自己的 tengine 上是自带了该模块的,大家可以访问淘宝tengine的官网来获取该版本的nginx,官方地址:http://tengine.taobao.org/。

如果我们没有使用淘宝的 tengine 的话,可以通过补丁的方式来添加该模块到我们自己的 nginx 中。模块官网:https://github.com/yaoweibin/nginx_upstream_check_module

安装git

# yum -y install git

下载源码

# git clone https://github.com/yaoweibin/nginx_upstream_check_module.git

下载nginx源码,跟进自己版本而定:http://nginx.org/download/

打补丁

进入nginx目录,需要注意,下载的nginx版本和补丁版本要严格对应,具体请参考官网解释,例如:

If you use nginx-1.2.1 or nginx-1.3.0, the nginx upstream round robin

module changed greatly. You should use the patch named

'check_1.2.1.patch'.

If you use nginx-1.2.2+ or nginx-1.3.1+, It added the upstream

least_conn module. You should use the patch named 'check_1.2.2+.patch'.

If you use nginx-1.2.6+ or nginx-1.3.9+, It adjusted the round robin

module. You should use the patch named 'check_1.2.6+.patch'.

If you use nginx-1.5.12+, You should use the patch named

'check_1.5.12+.patch'.

If you use nginx-1.7.2+, You should use the patch named

'check_1.7.2+.patch'.

我下载的1.12.2 就要用1.12.1+的,版本请对应好!(FAQ:其他版本例如1.11.2如遇到以下问题:)

[root@liukaitest2 nginx-1.11.2]# patch -p1 < /root/software/nginx_upstream_check_module/check_1.11.1+.patch

can't find file to patch at input line 4

Perhaps you used the wrong -p or --strip option?

The text leading up to this was:

--------------------------

|diff --git src/http/modules/ngx_http_upstream_hash_module.c src/http/modules/ngx_http_upstream_hash_module.c

|--- src/http/modules/ngx_http_upstream_hash_module.c 2016-05-31 15:43:51.000000000 +0200

|+++ src/http/modules/ngx_http_upstream_hash_module.c 2016-06-22 17:20:19.553955295 +0200

--------------------------

File to patch:

请把patch -p1 改为 patch -p0

# cd nginx-1.12.2 # patch -p1 < ../nginx_upstream_check_module/check_1.12.1+.patch

编译nginx:

# ./configure --prefix=/usr/local/nginx --user=nginx --group=nginx --with-http_ssl_module --with-http_realip_module --with-http_addition_module --with-http_gzip_static_module --with-http_stub_status_module --with-http_sub_module --with-pcre --add-module=../nginx_upstream_check_module #### 这个是必选,指向下载的补丁解压包。

测试:

配置文件:

upstream cluster { # simple round-robin server 172.16.204.130:8000; server 172.16.204.130:8001; check interval=1000 rise=1 fall=3 timeout=60000 type=http; } server { listen 80; server_name nginx.check.com; access_log logs/nginx_check_access_log main; location / { proxy_pass http://cluster; } location /status { check_status; access_log logs/nginx_check_status_access_log main; } }

详细解释:

上面配置的意思是,对cluster这个负载均衡条目中的所有节点,每1000ms检测一次,请求1次正常则标记 realserver状态为up,如果检测 3 次都失败,则标记 realserver的状态为down,超时时间为60000ms,检测类型:http。

官网解释:

Syntax: check interval=milliseconds [fall=count] [rise=count] [timeout=milliseconds] [default_down=true|false] [type=tcp|http|ssl_hello|mysql|ajp] [port=check_port]

Default: 如果没有配置参数,默认值是:interval=30000 fall=5 rise=2 timeout=1000 default_down=true type=tcp

Context: upstream

中文详细解释:

- interval:向后端发送的健康检查包的间隔。

- fall(fall_count): 如果连续失败次数达到fall_count,服务器就被认为是down。

- rise(rise_count): 如果连续成功次数达到rise_count,服务器就被认为是up。

- timeout: 后端健康请求的超时时间。

- default_down: 设定初始时服务器的状态,如果是true,就说明默认是down的,如果是false,就是up的。默认值是true,也就是一开始服务器认为是不可用,要等健康检查包达到一定成功次数以后才会被认为是健康的。

- type:健康检查包的类型,现在支持以下多种类型

- tcp:简单的tcp连接,如果连接成功,就说明后端正常。

- ssl_hello:发送一个初始的SSL hello包并接受服务器的SSL hello包。

- http:发送HTTP请求,通过后端的回复包的状态来判断后端是否存活。

- mysql: 向mysql服务器连接,通过接收服务器的greeting包来判断后端是否存活。

- ajp:向后端发送AJP协议的Cping包,通过接收Cpong包来判断后端是否存活。

- port: 指定后端服务器的检查端口。你可以指定不同于真实服务的后端服务器的端口,比如后端提供的是443端口的应用,你可以去检查80端口的状态来判断后端健康状况。默认是0,表示跟后端server提供真实服务的端口一样。该选项出现于Tengine-1.4.0。

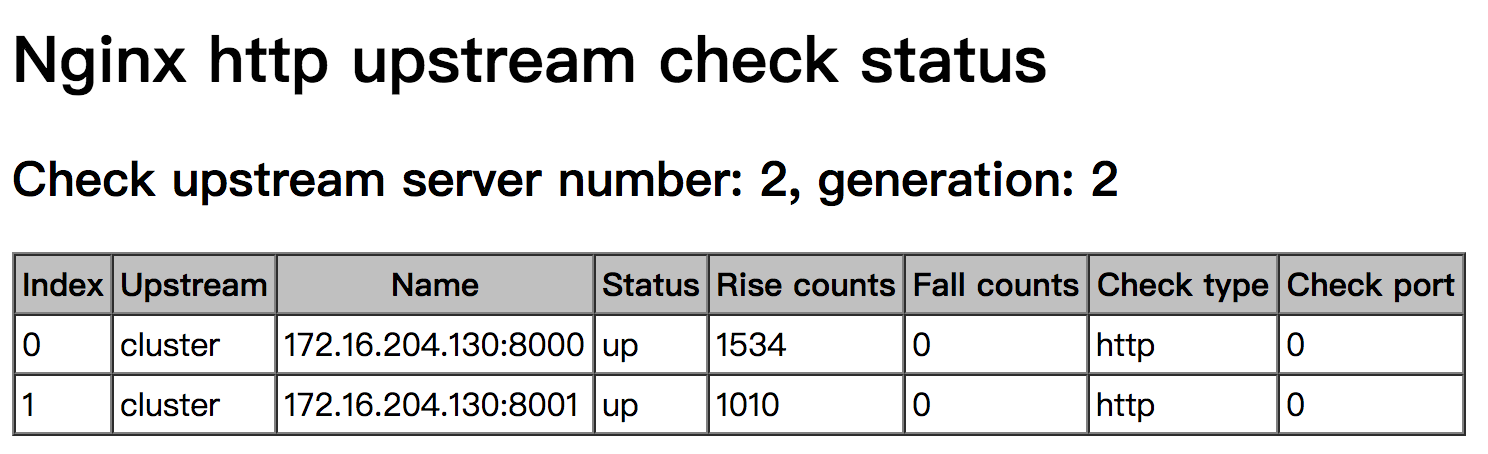

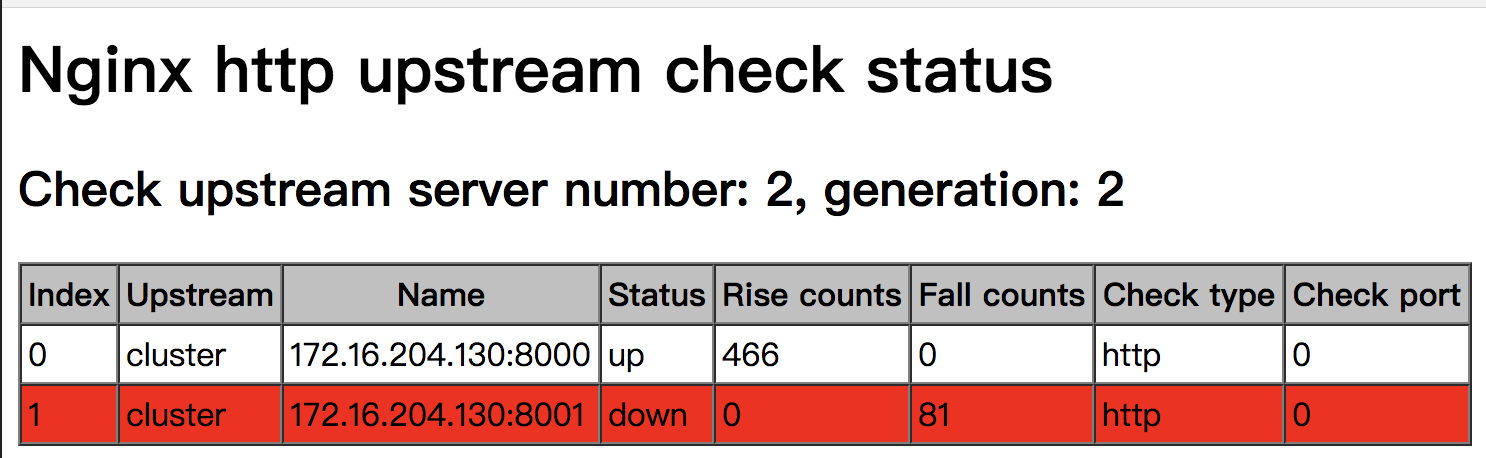

check_status:健康检查页面,可以通过域名/status(自定义配置) 查看节点状况。例如:

测试现象:正常轮训

172.16.204.1 - - [29/Nov/2017:09:23:09 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000

172.16.204.1 - - [29/Nov/2017:09:23:10 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8001

172.16.204.1 - - [29/Nov/2017:09:23:11 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000

172.16.204.1 - - [29/Nov/2017:09:23:12 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8001

172.16.204.1 - - [29/Nov/2017:09:23:13 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000

172.16.204.1 - - [29/Nov/2017:09:23:14 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8001

挂掉8001端口

测试现象:标记为down,正常切换,何时检测为正常在标志位up

172.16.204.1 - - [29/Nov/2017:09:25:44 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000 172.16.204.1 - - [29/Nov/2017:09:25:45 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8001 172.16.204.1 - - [29/Nov/2017:09:25:46 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000 172.16.204.1 - - [29/Nov/2017:09:25:47 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8001, 172.16.204.130:8000 172.16.204.1 - - [29/Nov/2017:09:25:48 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000 172.16.204.1 - - [29/Nov/2017:09:25:49 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000 172.16.204.1 - - [29/Nov/2017:09:25:51 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000

服务恢复后(经过定义好的rise次数之后):

172.16.204.1 - - [29/Nov/2017:09:53:44 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000 172.16.204.1 - - [29/Nov/2017:09:53:45 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8001 172.16.204.1 - - [29/Nov/2017:09:53:46 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8000 172.16.204.1 - - [29/Nov/2017:09:53:47 +0800] "GET / HTTP/1.1" 200 2072 "-" "curl/7.54.0" "-" 172.16.204.130:8001

在生产环境的实施应用中,需要注意的有 2 点:

1、主要定义好type。由于默认的type是tcp类型,因此假设你服务启动,不管是否初始化完毕,它的端口都会起来,所以此时前段负载均衡器为认为该服务已经可用,其实是不可用状态。

2、注意check_http_send值的设定。由于它的默认值是"GET / HTTP/1.0 "。假设你的应用是通过http://ip/name访问的,那么这里你的check_http_send值就需要更改为"GET /name HTTP/1.0 "才可以。针对采用长连接进行检查的,这里增加keep-alive请求头,即"HEAD /name HTTP/1.1 Connection: keep-alive "。如果你后端的tomcat是基于域名的多虚拟机,此时你需要通过check_http_send定义host,不然每次访问都是失败,范例:check_http_send "GET /mobileapi HTTP/1.0 HOST www.redhat.sx ";

测试配置文件:

三、ngx_http_healthcheck_module

除了上面两个模块,nginx官方在早期的时候还提供了一个 ngx_http_healthcheck_module 模块用来进行nginx后端节点的健康检查。nginx_upstream_check_module模块就是参照该模块的设计理念进行开发的,因此在使用和效果上都大同小异。但是需要注意的是,ngx_http_healthcheck_module 模块仅仅支持nginx的1.0.0版本,1.1.0版本以后都不支持了!因此,对于目前常见的生产环境上都不会去用了,这里仅仅留个纪念,给大家介绍下这个模块!

具体的使用方法,这里可以贴出几篇靠谱的博文地址以及官方地址:

http://wiki.nginx.org/HttpHealthcheckModule