概述

逻辑回归(logistic regression)是统计学习中的经典分类方法。最大熵是概率模型学习的一个准则,将其推广到分类问题得到最大熵模型(maximum entropy model)。

逻辑回归模型与最大熵模型都属于对数线性模型。

逻辑斯蒂回归模型

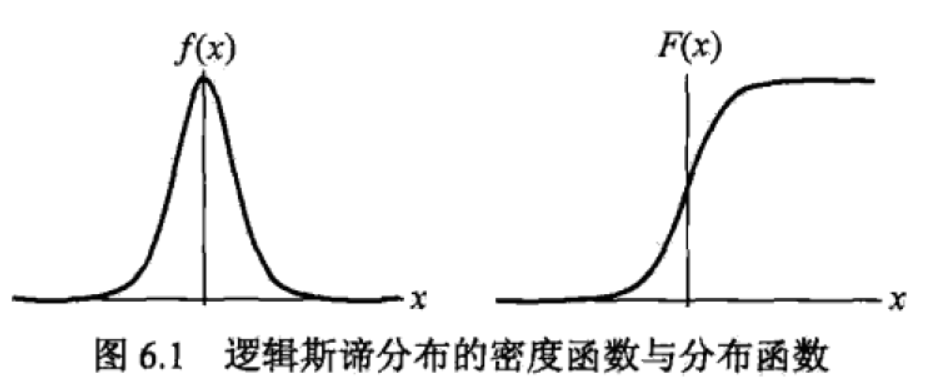

1、逻辑斯蒂分布

式中,u为位置参数,r>0为形状参数。

二项逻辑回归模型(binomial logistic regression model)是一种分类模型,用于二类分类。由条件概率分布P(Y|X)表示,形式为参数化的逻辑分布。这里,随机变量X取值为实数,随机变量Y取值为1或0。

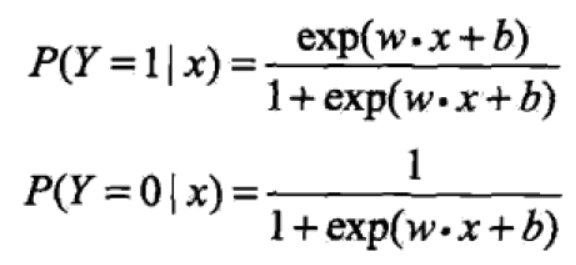

定义6.2 (逻辑回归模型):二项逻辑回归模型是如下的条件概率分布:

w称为权值向量,b称为偏置,w.x为w和x的内积。将权值向量和输入向量加以扩充为 w=(w, b), x =(x,1),逻辑回归模型如下

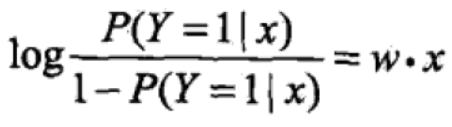

一个事件的几率(odds)是指该事件发生的概率与该事件不发生的概率的比值,如果事件发生的概率是p,那么该事件的对数几率(log odds)或logit函数是

对逻辑回归而言, 。这就是说,在逻辑回归模型中,输出Y=1的对数几率是由输入x的线性函数表示的模型。

。这就是说,在逻辑回归模型中,输出Y=1的对数几率是由输入x的线性函数表示的模型。

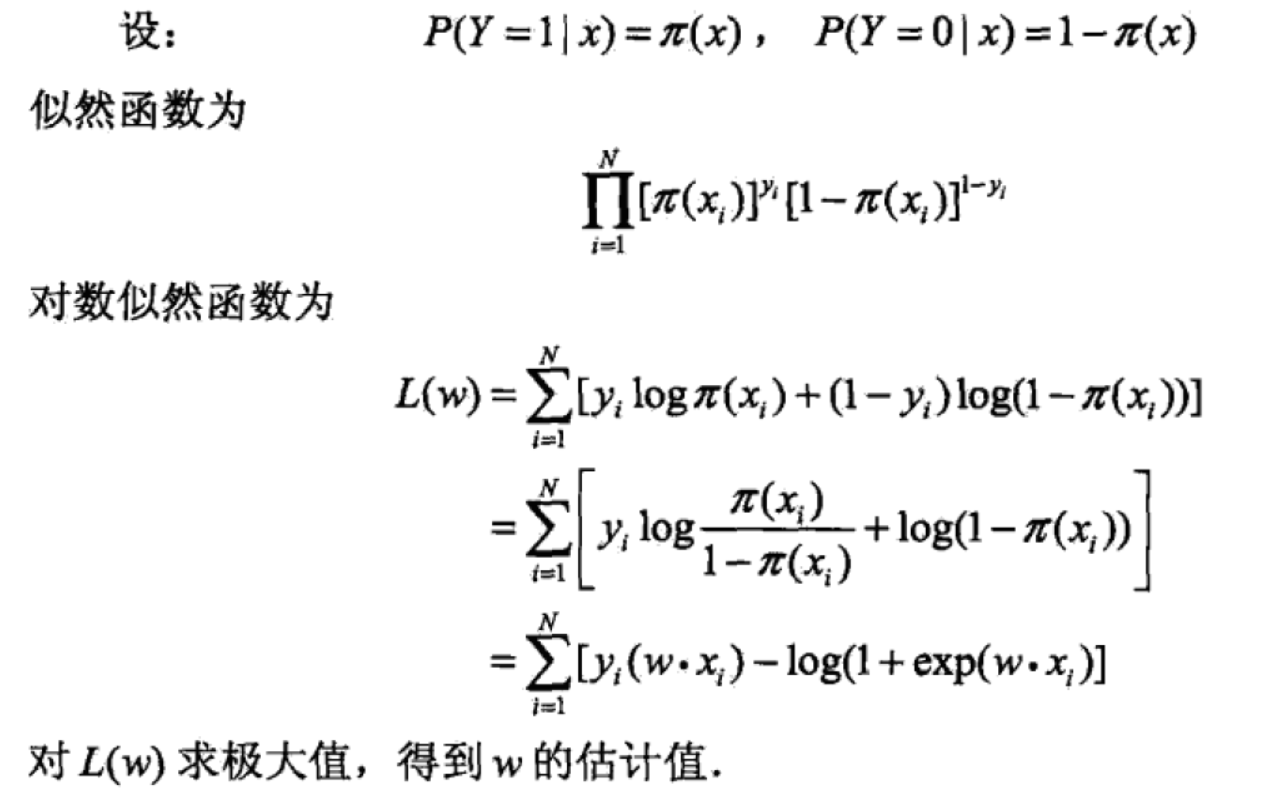

3、模型参数估计

这样,问题就变成了以对数似然函数为目标函数的最优化问题。逻辑回归学习中诵常采用梯度下降法及拟牛顿法。

4、多项逻辑斯蒂回归模型

最大熵模型

1、最大熵原理

最大熵原理是概率模型学习的一个准则。

最大熵原理认为,学习概率模型时,在所有可能的概率模型(分布)中,熵最大的模型是最好的模型。通常用约束条件来确定概率模型的集合,所以,最大熵原理也可以表述为在满足约束条件的模型集合中选取熵最大的模型。均匀分布时,熵最大。

最大熵原理认为要选择的概率模型首先必须满足约束条件。在没有更多信息的情况下,那些不确定的部分都是“等可能的”。最大熵原理通过熵的最大化来表示等可能性.“等可能”不容易操作,而熵则是一个可优化的数值指标.

2、最大熵模型的定义

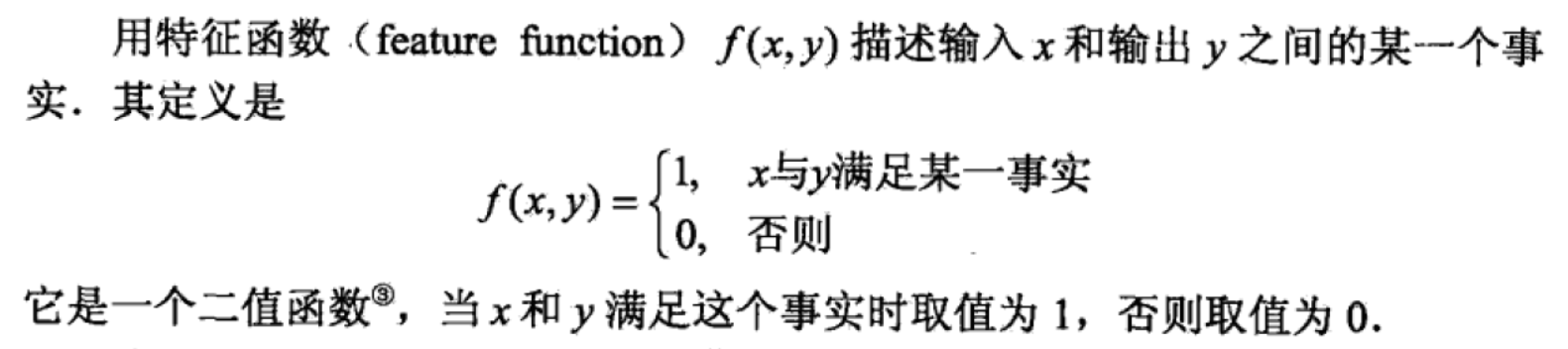

(1)特征函数

(2)联合和边缘经验分布

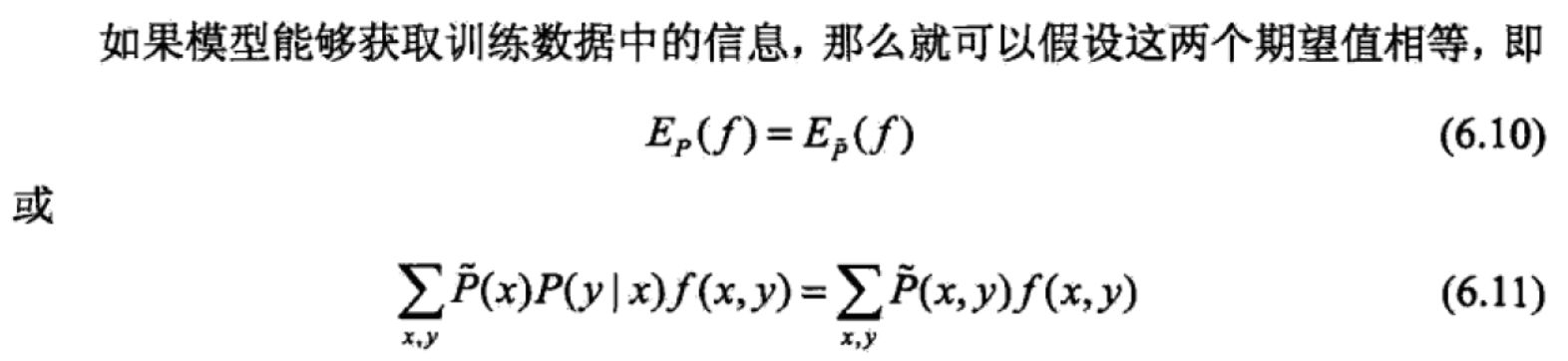

(3)约束条件

其中特征函数f(x,y)关于经验分布P~(X,Y)的期望值,用EP~(f)表示:![]()

定义6.3(最大熵模型):假设满足所有约束条件的模型集合为:![]()

定义在条件概率分布P(Y|X)上的条件熵为:![]()

则模型集合C中条件熵H(P)最大的模型称为最大熵模型。

3、最大熵模型的学习

最大熵模型的学习过程就是求解最大熵模型的过程,可以形式化为约束最优化问题:

求解流程图如下,详细公式推导可见书或者博客https://blog.csdn.net/tina_ttl/article/details/53542004或者https://blog.csdn.net/dashuye4/article/details/38032843。

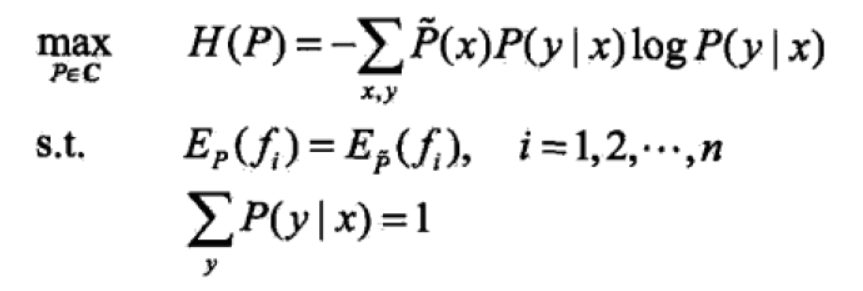

4、极大似然估计

(1)条件概率的似然函数

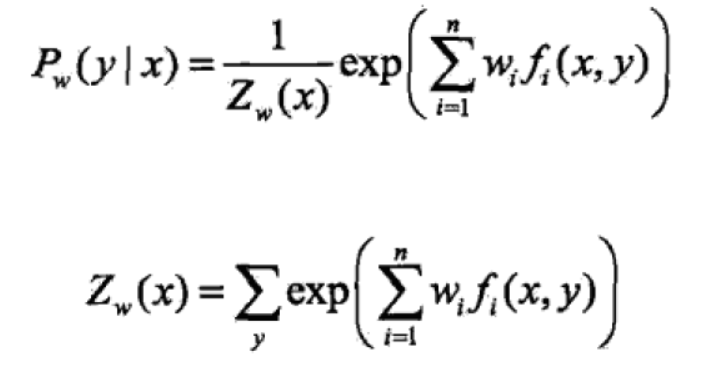

(2)在求解对偶问题的第一步中,我们已经得到P如下,即模型已经有了,缺的是其中参数w的值。

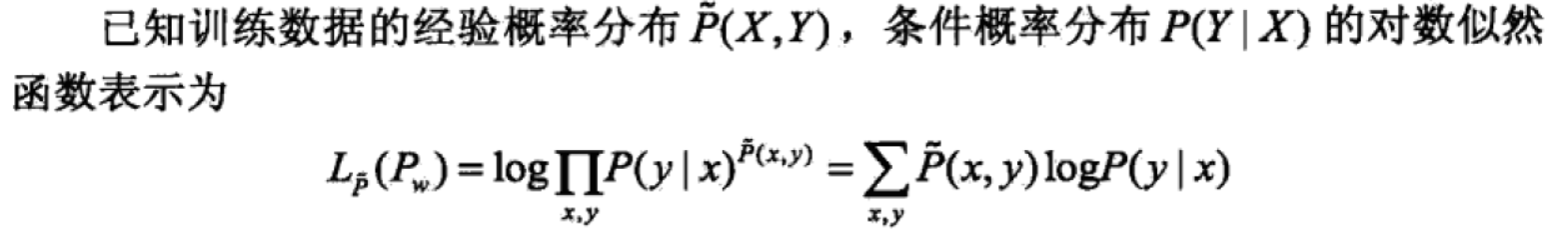

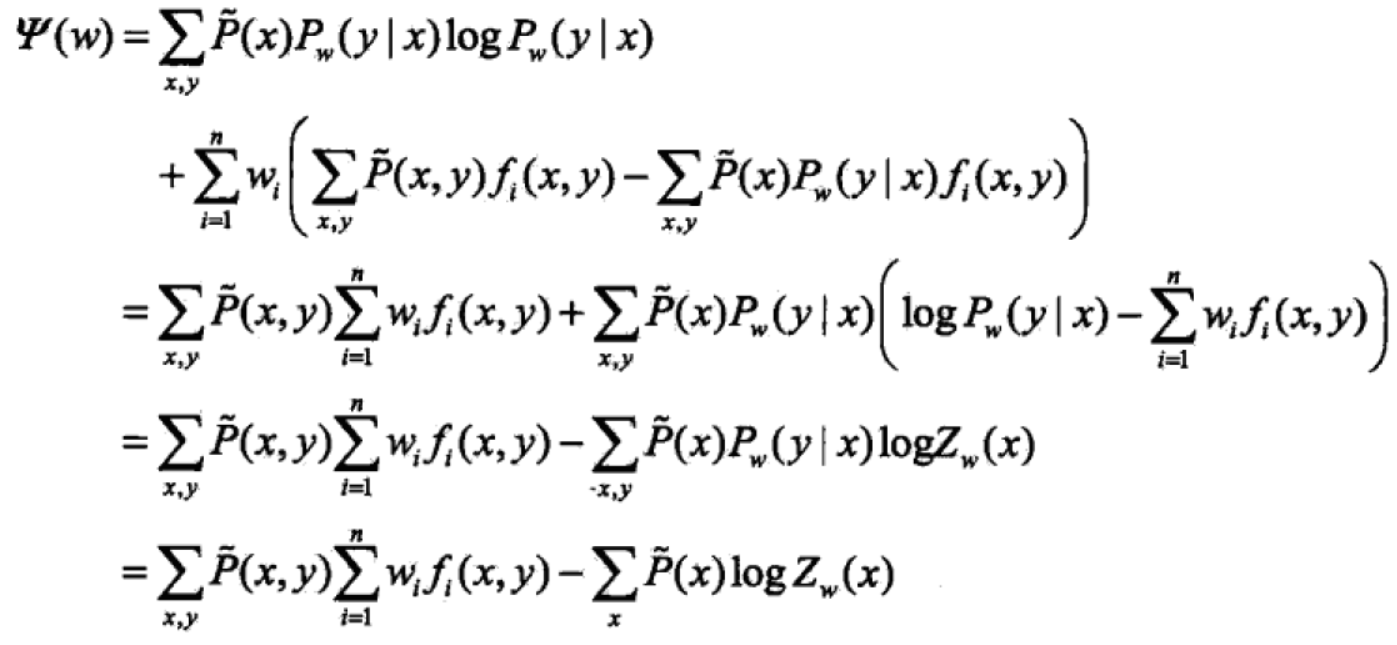

接下来使用A对偶函数和B极大使然估计中的对数似然函数是一样的

A、对偶函数

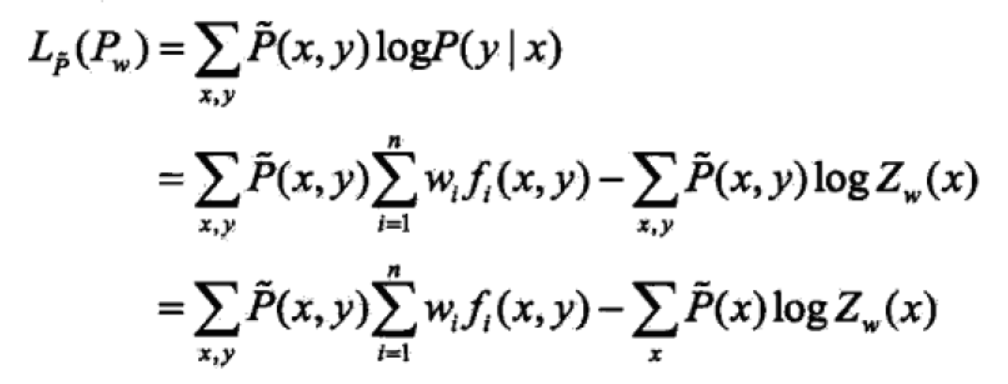

B、极大使然估计中的对数似然函数

也就是说,最大熵模型学习中的对偶函数极大化等价于最大熵模型的极大似然估计,最大熵模型的学习问题就转换为具体求解对数似然函数极大化或对偶函数极大化的问题。此时可用最优化的算法求解。

模型学习的最优化算法

逻辑斯谛回归模型、最大熵模型学习归结为以似然函数为目标函数的最优化问题,通常通过迭代算法求解.从最优化的观点看,这时的目标函数具有很好的性质.它是光滑的凸函数,因此多种最优化的方法都适用.保证能找到全局最优解.

常用的方法有改进的迭代尺度法、梯度下降法、牛顿法或拟牛顿法.牛顿法或拟牛顿法一般收敛速度更快.

(才疏学浅。。这一块内容理解有限,不敢妄言)