内容基于(自己的真是操作步骤编写)

一:下载安装 Hadoop

1.1:下载指定的Hadoop

hadoop-2.8.0.tar.gz

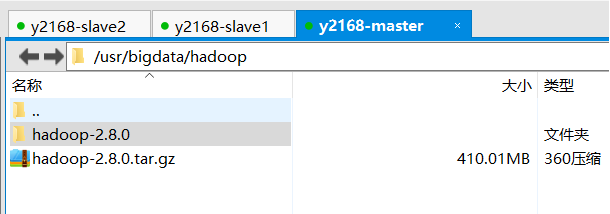

1.2:通过XFTP把文件上传到master电脑bigData目录下

1.3:解压hadoop压缩文件

tar -xvf hadoop-2.8.0.tar.gz

1.4:进入压缩文件之后 复制路径

/bigData/hadoop-2.8.0

1.5:配置Hadoop的环境变量

vim /etc/profile

添加如下配置:

export HADOOP_HOME=/usr/bigdata/hadoop/hadoop-2.8.0

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

让文件生效:

wq!保存并退出

source /etc/profile让文件生效

二:Hadoop集群的配置

2.1:进入hadoop的配置文件位置

进入hadoop配置文件目录

cd hadoop2.8.0/etc/hadoop/

2.2:配置hadoop-env.sh文件

vim hadoop-env.sh

加入如下配置:

export JAVA_HOME=/usr/bigdata/java/jdk1.8.0_121

2.3:配置yarn-env.sh文件

vim yarn-env.sh

加入如下配置:

export JAVA_HOME=/usr/bigdata/java/jdk1.8.0_121

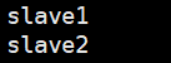

2.4:配置slaves文件,增加slave主机名或者IP地址

01.vim slaves

删除原有localhost,加入子机器名称或者ip地址

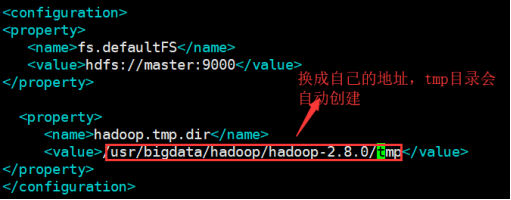

2.5:配置core-site.xml文件

01.vim core-site.xml

02.在configuration节点下加入如下配置:

<property>

<name>fs.defaultFS</name>

<value>hdfs://master:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/bigdata/hadoop/hadoop-2.8.0/tmp</value>

</property>

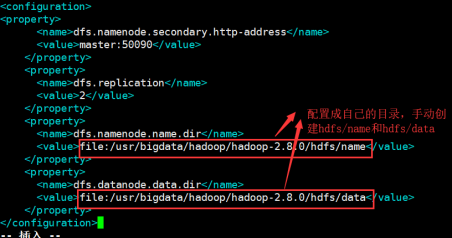

2.6:配置hdfs-site.xml文件

vim hdfs-site.xml

在configuration节点下加入如下配置:

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>master:50090</value>

</property>

<property>

<name>dfs.replication</name>

<value>2</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/usr/bigdata/hadoop/hadoop-2.8.0/hdfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/usr/bigdata/hadoop/hadoop-2.8.0/hdfs/data</value>

</property>

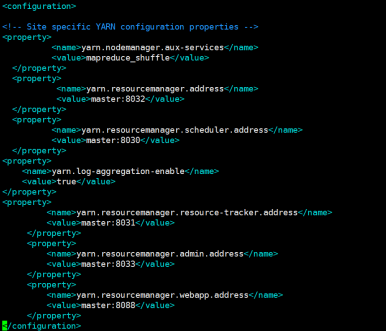

2.7:配置yarn-site.xml文件

在configuration节点下加入如下配置:

vim yarn-site.xml

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.resourcemanager.address</name>

<value>master:8032</value>

</property>

<property>

<name>yarn.resourcemanager.scheduler.address</name>

<value>master:8030</value>

</property>

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<property>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>master:8031</value>

</property>

<property>

<name>yarn.resourcemanager.admin.address</name>

<value>master:8033</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>master:8088</value>

</property>

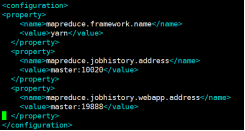

2.8:配置mapred-site.xml文件

mapred-site.xml.template存在

mapred-site.xml不存在

先要copy一份

cp mapred-site.xml.template mapred-site.xml

然后编辑

vim mapred-site.xml

在configuration节点下加入如下配置:

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<property>

<name>mapreduce.jobhistory.address</name>

<value>master:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>master:19888</value>

</property>

2.9:把配置好的hadoop文件复制到其他的子机器中

scp -r /usr/bigdata/hadoop/hadoop-2.8.0 root@slave1:/usr/bigdata/hadoop

scp -r /usr/bigdata/hadoop/hadoop-2.8.0 root@slave2:/usr/bigdata/hadoop

3.0把配置好的/etc/profile复制到其他两个子机器中

scp /etc/profile root@slave1:/etc/profile

scp /etc/profile root@slave2:/etc/profile

分别在两个子机器中应用/etc/profile

source /etc/profile

3.1:在master 主机器中运行

hdfs namenode -format

3.2:在master 主机器中启动hadoop环境

进入/usr/bigdata/hadoop/hadoop-2.8.0/sbin

./start-all.sh 启动hadoop集群

./stop-all.sh 关闭hadoop集群

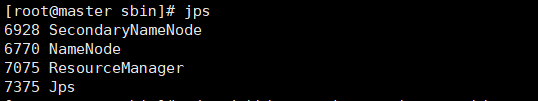

3.3:jps

vim jps

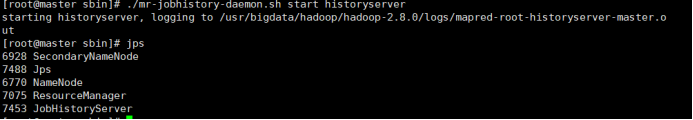

3.4:启动JobHistoryServer

./mr-jobhistory-daemon.sh start historyserver

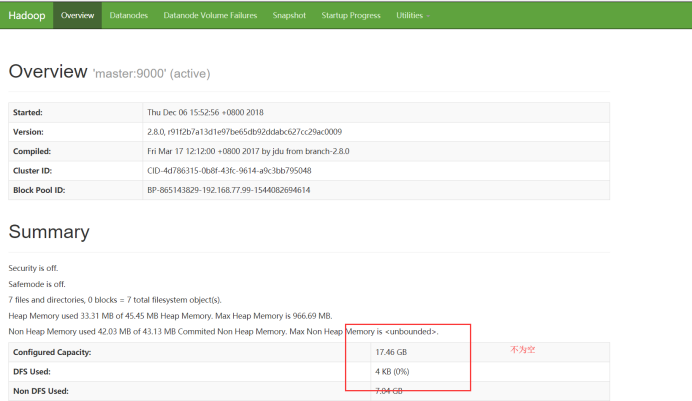

访问页面:

Hadoop集群搭建成功

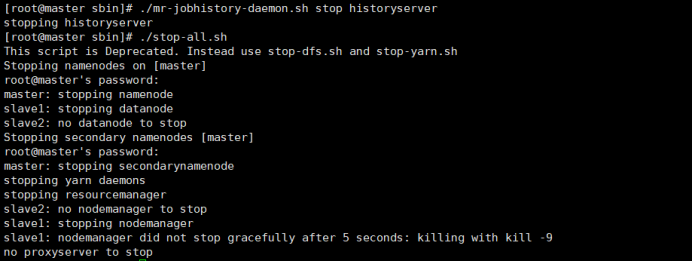

3.5关闭:

第一步:

关闭JobHistoryServer

./mr-jobhistory-daemon.sh stop historyserver

第二步:

关闭hadoop集群

./stop-all.sh