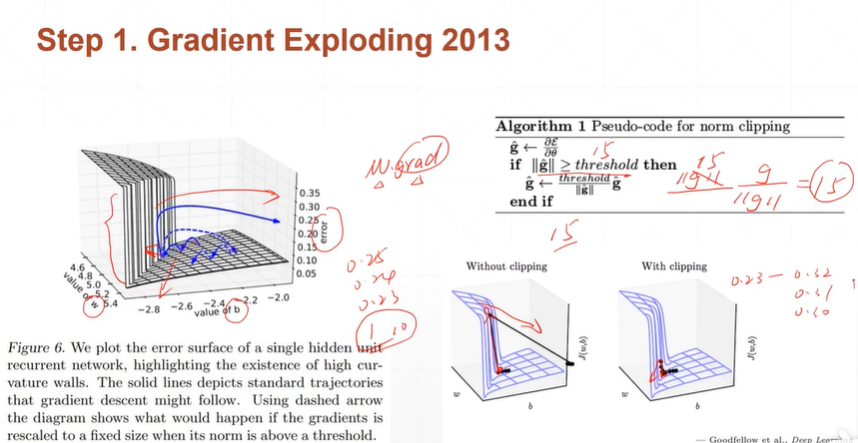

1:RNN训练难题:梯度爆炸以及梯度弥散

(1.1)原因

[注]由于W**k的存在导致梯度出现爆炸或者弥散

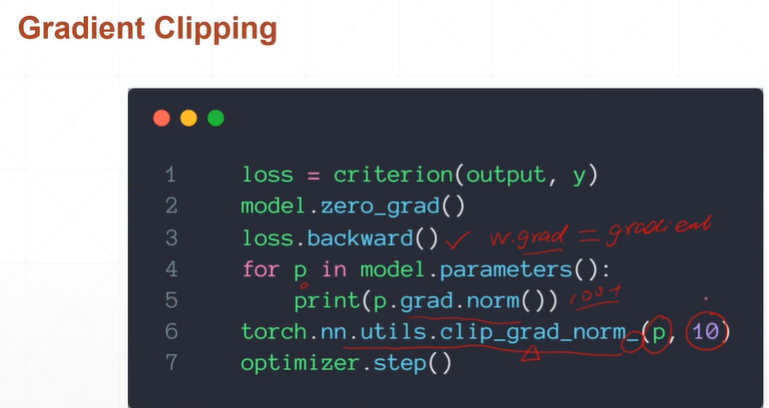

2:解决办法

(2.1)梯度爆炸的解决办法:梯度压缩

[注]可以通过对w的梯度进行压缩:(w.grad/||w.gard||)*threashold解决梯度爆炸的问题

【注】norm()函数可以求二范数或者是向量的模或欧几里得长度。

(2.2)梯度弥散(梯度消失)的解决办法:LSTM

[注]在CNN中随着网络层数的加深,由于误差的存在会导致后面几层的梯度=0,参数长时间得不到更新,这样就导致了优化效果不好。